피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

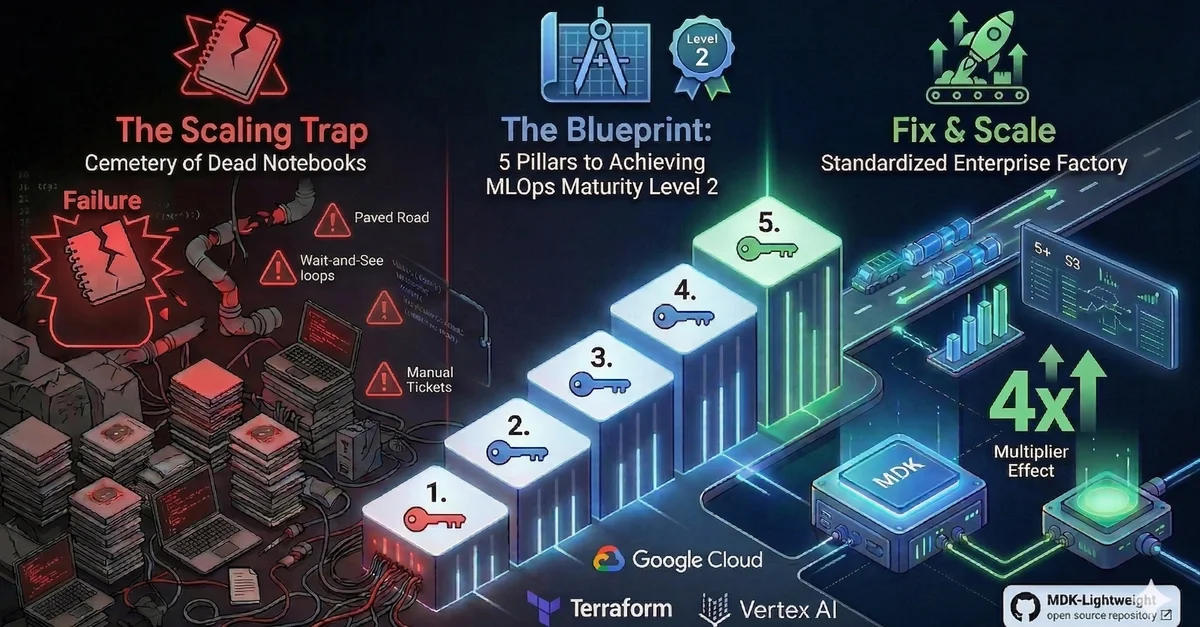

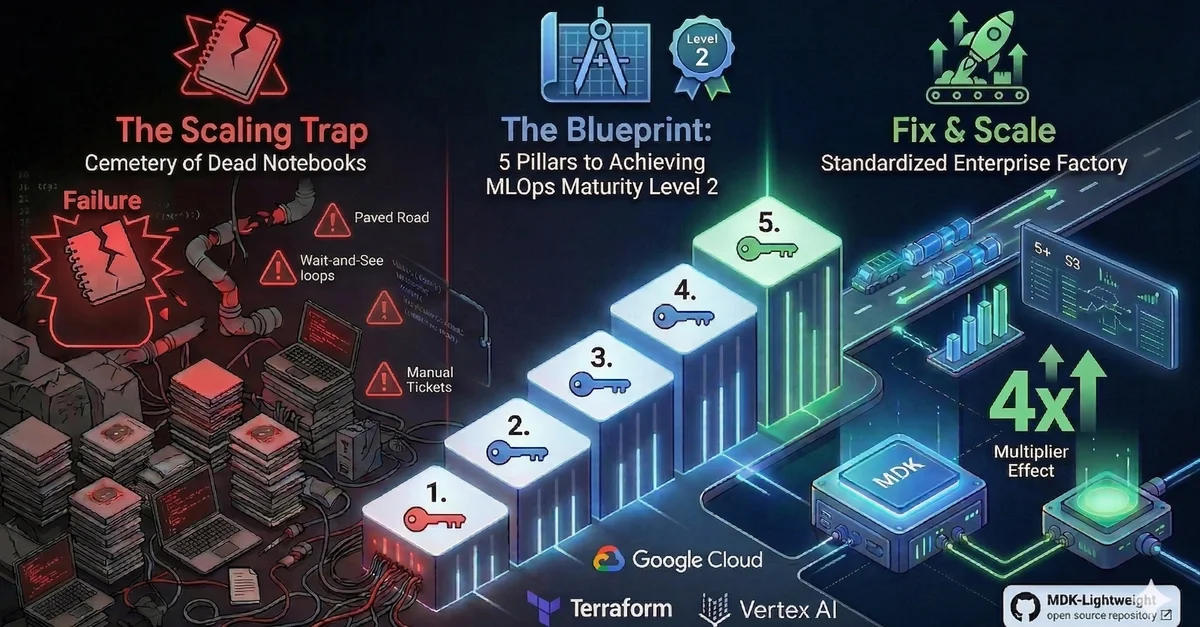

디버깅 루프 60배 단축 및 배포 속도 4배 향상시킨 Managed MLOps Platform

Why Your Enterprise MLOps Strategy is Failing to Scale—and How to Fix It

AI 요약

Context

데이터 사이언티스트가 IaC 및 인프라 관리를 직접 수행함에 따라 발생하는 생산성 저하와 인적 자원 의존적 확장 모델의 한계 직면. 로컬 개발 환경과 클라우드 플랫폼 간의 괴리로 인한 긴 피드백 루프와 거버넌스 부재로 프로젝트 간 파편화 심화.

Technical Solution

- Terraform 기반 Automated IaC 도입을 통한 표준화된 샌드박스 환경의 즉각적 프로비저닝 체계 구축

- MDK(MLOps Development Kit)의 YAML 기반 추상화 레이어를 통해 복잡한 Kubeflow Pipelines 코드를 단순 설정으로 대체

- mdk run --local CLI 구현으로 클라우드 전송 전 로컬 검증을 가능케 하여 디버깅 사이클 최적화

- GitOps 기반의 선언적 배포 모델을 적용하여 operations.yaml 파일 수정을 통한 모델 프로모션 및 롤백 자동화

- Pub/Sub와 Cloud Run을 연동한 Event-Driven 아키텍처로 데이터 드리프트 감지 시 자동 재학습 파이프라인 트리거 구현

- Vertex AI Model Monitoring과 연계한 Shadow 및 Canary 배포 패턴 적용으로 운영 리스크 최소화

실천 포인트

1. 모델 학습-배포 파이프라인의 피드백 루프가 1분 이상인지 확인하고 로컬 테스트 환경 구축 검토

2. 인프라 설정이 티켓 기반의 수동 프로세스인지 확인하고 Terraform 기반 Self-Service Provisioning 도입 고려

3. 모델 상태 변경(Champion/Challenger)을 UI 클릭이 아닌 Git 기반의 선언적 설정 파일로 관리하는지 점검

4. 데이터 드리프트 발생 시 수동 개입 없이 재학습이 시작되는 Event-Driven 워크플로우 설계 검토