피드로 돌아가기

The RegisterInfrastructure

The RegisterInfrastructure

원문 읽기

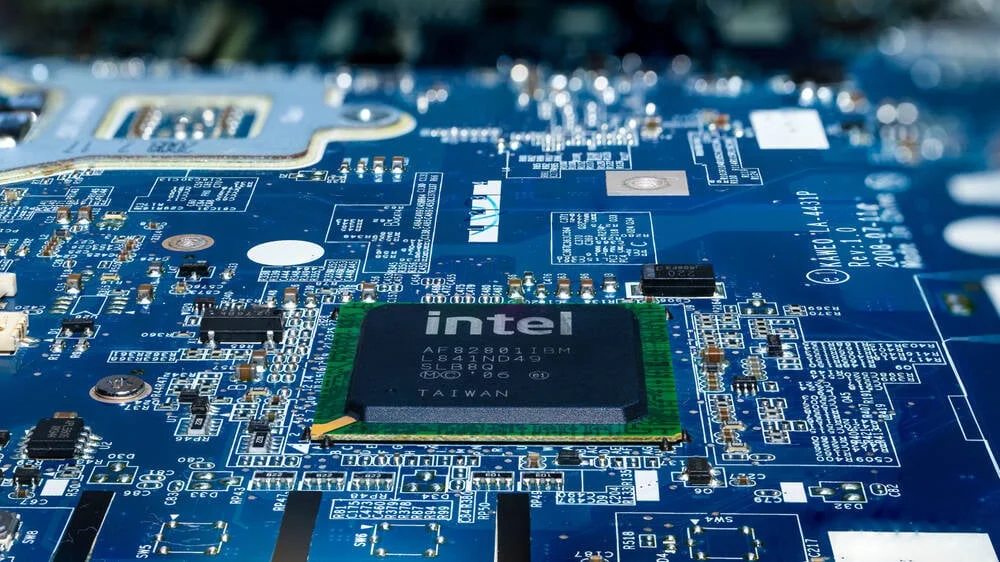

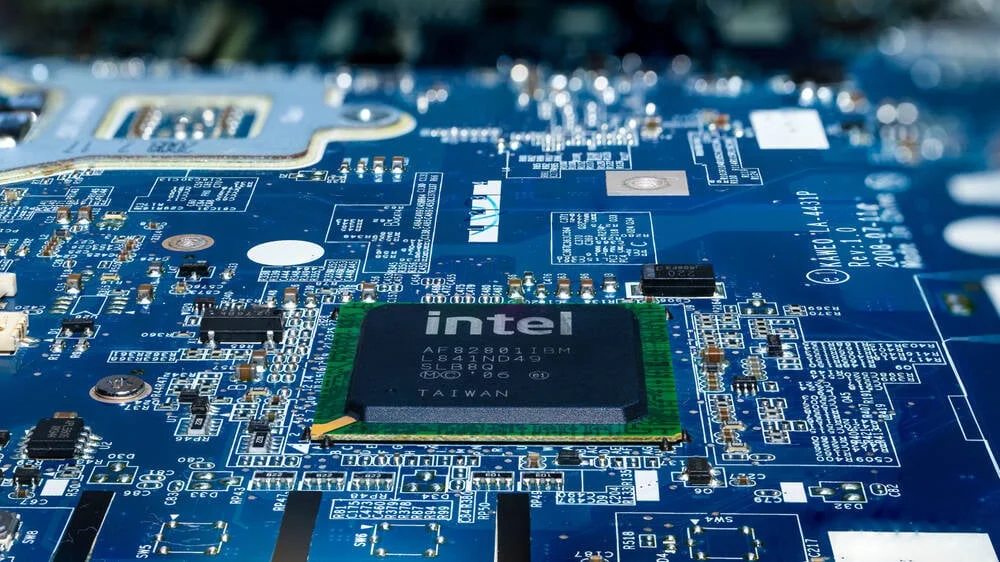

Google Cloud의 인프라 가속화를 위한 Intel IPU 전략 분석

Google wants more Intel inside ... its datacenters, taps Chipzilla for more SmartNICs

AI 요약

Context

하이퍼스케일 데이터센터의 CPU 자원 고갈 문제 발생. 네트워크, 보안, 스토리지 연산이 CPU 부하를 가중하는 구조. 테넌트 워크로드 처리를 위한 가용 컴퓨팅 자원 확보 필요.

Technical Solution

- 네트워크 카드 내에 컴퓨터를 통합한 SmartNIC(IPU) 도입을 통한 인프라 오프로딩 설계

- Intel과 협력하여 ASIC 기반의 Mount Evans IPU 개발 및 C3 인스턴스 적용

- 네트워크·보안·스토리지 연산 처리를 전담하여 메인 CPU의 워크로드 처리 효율 극대화

- AI 컴퓨팅 클러스터의 고속 네트워크 수요 대응을 위한 차세대 IPU 공동 개발 확장

- 범용 및 AI 워크로드 처리를 위한 Xeon 프로세서의 병행 운용 전략 유지

- 고객사 호환성 및 성능 요구사항 충족을 위한 x86 코어 기반의 인프라 구성

Impact

- Intel의 커스텀 ASIC 사업 성장률 50% 이상 기록

- Intel 커스텀 ASIC 사업의 연간 매출 런레이트 10억 달러 초과 달성

- Mount Evans IPU 기준 200 Gbps 네트워크 속도 제공

Key Takeaway

특수 목적의 ASIC 기반 가속기를 통해 제어 평면과 데이터 평면을 분리함으로써 하이퍼스케일 환경의 리소스 효율을 최적화하는 설계 원칙.

실천 포인트

CPU 부하가 높은 네트워크·스토리지 I/O 집약적 서비스의 경우 SmartNIC나 IPU 기반 오프로딩 도입을 통한 CPU 자원 확보를 검토할 것