피드로 돌아가기

GeekNewsAI/ML

GeekNewsAI/ML

원문 읽기

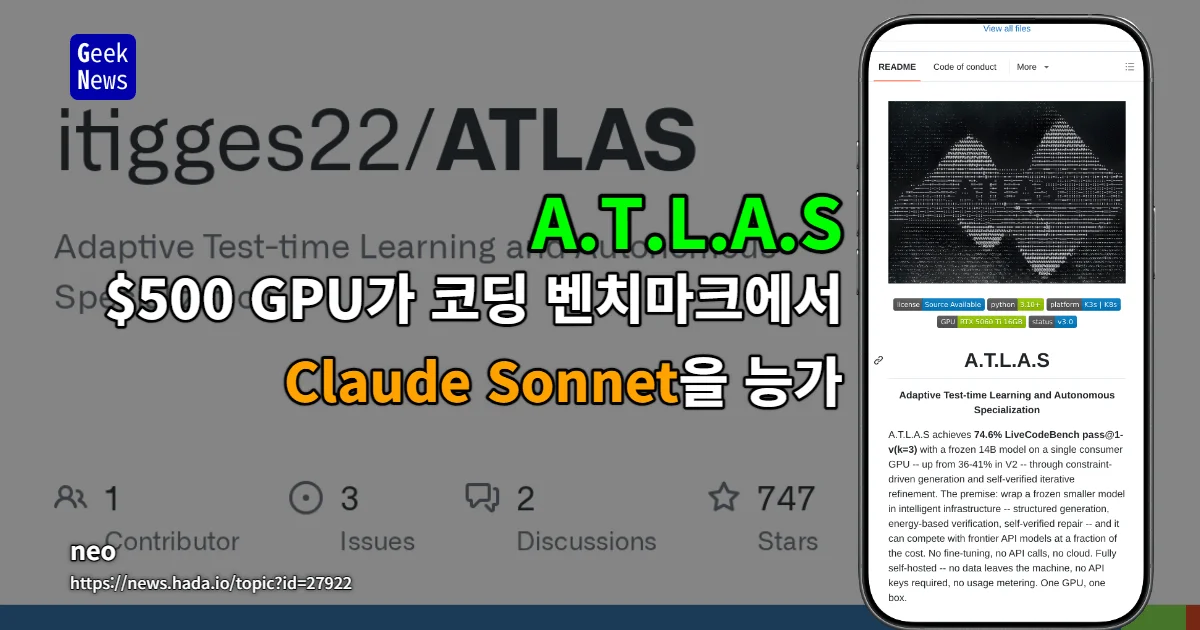

A.T.L.A.S - $500 GPU가 코딩 벤치마크에서 Claude Sonnet을 능가

ATLAS가 best-of-3 생성 + Lens 라우팅 + 반복 수정 파이프라인으로 $500 GPU에서 Claude Sonnet을 능가하는 74.6% 정확도 달성

AI 요약

Context

기존 LLM 벤치마크는 단일 실행(pass@1) 기준으로만 평가되어 실제 개발 업무와의 괴리가 큼. 일반적인 코딩 태스크 평가는 대규모 코드 생성보다 로그 분석, 디버깅, 소규모 일관된 변경(하드 딜리트→소프트 딜리트 리팩토링 등) 능력이 더 실용적임에도 불구하고 이를 제대로 측정하는 벤치마크가 부족함.

Technical Solution

- 여러 해답 생성 후 선별: 코드 임베딩 지문(fingerprint)을 계산해 정확도를 예측하는 방식으로 테스트 시간을 줄임

- Cost Field 신경망 도입: 작은 신경망이 생성된 코드들을 점수화해 가장 가능성 높은 솔루션 선택

- Geometric Lens 라우팅 적용: 여러 솔루션을 생성하고 가능성 높은 후보를 반복 테스트 및 피드백

- 유전 알고리즘 방식 수렴: 점진적으로 솔루션을 개선하는 반복 수정(iterative repair) 파이프라인 구성

- 모델 라우팅과 reasoning budget 관리: 작업 난이도에 따라 최적의 모델 선택 및 추론 토큰 사용량 최적화

Impact

- ATLAS V3 (best-of-3 + Lens + 반복 수정): LiveCodeBench 599개 작업 기준 74.6% 정확도 달성

- DeepSeek V3.2 Reasoning: 86.2% 정확도 (~$0.002 API 비용 기준 단일 실행)

- 88% 정확도로 올바른 해답 선택하면서 테스트 시간 단축

- 월 10유로 요금제로 5시간마다 1500회 코딩 요청 가능 (MiniMax 기준)

Key Takeaway

현재 벤치마크 환경은 문제 전용 최적화에만 효과적이므로, 실제 개발 작업에 모델을 적용할 때는 pass@1 단일 점수보다 best-of-k + 반복 수정 같은 파이프라인 전체를 고려해야 함. 또한 단순 토큰 단가보다 작업별 효율성을 기준으로 모델을 선택하는 하네스 설계가 핵심임.

실천 포인트

대규모 코드 생성 태스크를 처리하는 개발 팀에서 단일 모델 호출 대신 best-of-3 생성 + 소형 신경망 기반 후보 선별 + 반복 수정 파이프라인을 구성하면, 단일 실행보다 높은 정확도를 달성할 수 있음. 동시에 모델 라우팅(어려운 작업은 Opus, 일상적 작업은 MiniMax)으로 월 요금을 관리하되, 시스템 프로그래밍(C++, Rust) 같은 복잡한 영역에서는 여전히 Claude Sonnet 수준의 최신 모델이 필요함을 염두에 둬야 함.