피드로 돌아가기

Dev.toCareer

Dev.toCareer

원문 읽기

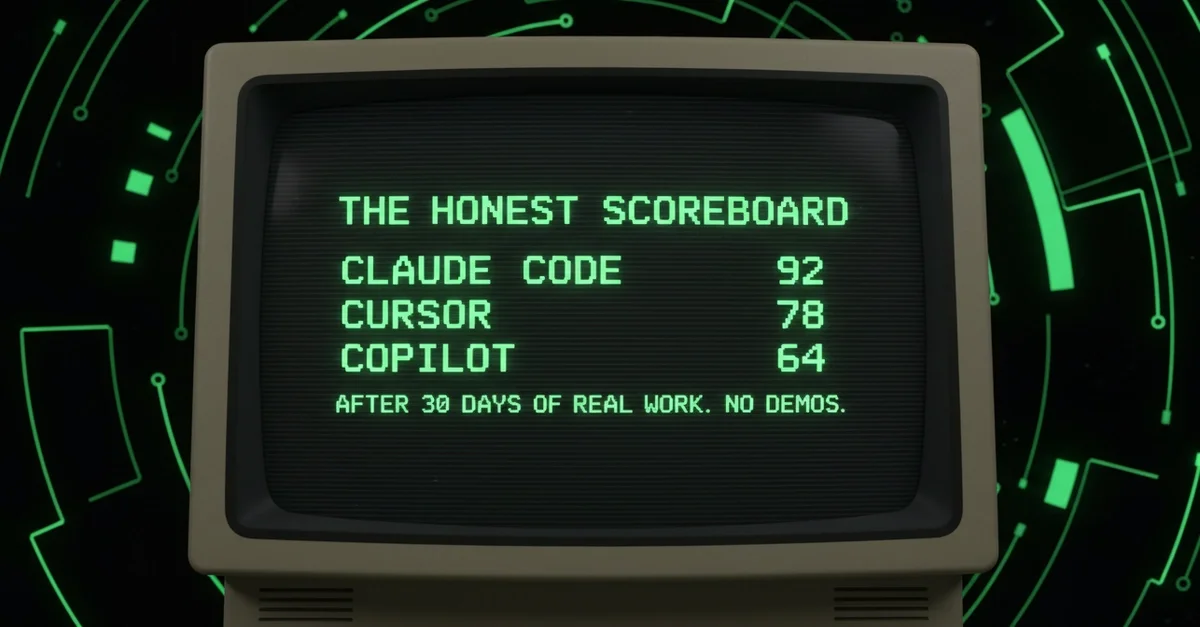

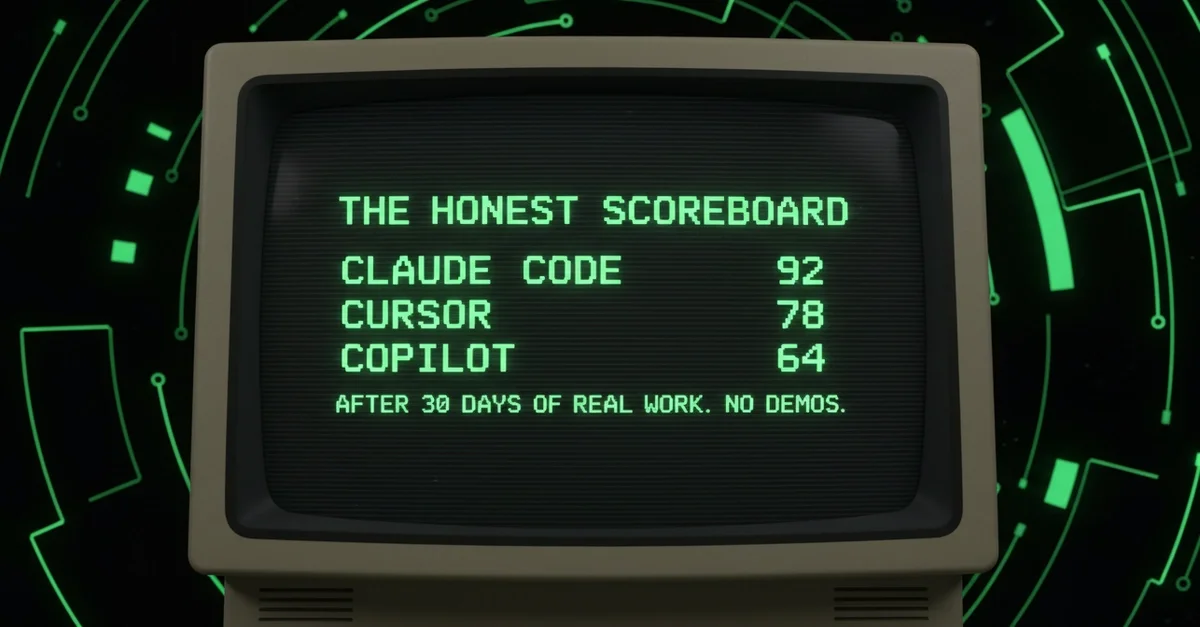

Claude Code vs Cursor vs GitHub Copilot: Honest Comparison After 30 Days

백엔드 엔지니어가 30일간 Claude Code, Cursor, GitHub Copilot을 실제 업무에 적용해 각 도구의 추론 품질과 인터페이스 트레이드오프를 정량 비교

AI 요약

Context

팀이 AI 코딩 어시스턴트 도입을 앞두고 있었으나 벤더 데모와 마케팅 자료만으로는 의사결정이 어려웠다. Python FastAPI 백엔드, TypeScript React 프론트엔드, PostgreSQL, Django 레거시 서비스가 혼재된 환경에서 실제 프로덕션 작업을 기준으로 도구를 평가해야 했다.

Technical Solution

- Claude Code(터미널 기반): 600줄 서비스 파일을 4개 파일로 분해하는 리팩토링 시 구조화된 계획을 사전 제시 후 협업적 진행, 예상 소요 시간 8시간 → 실제 2시간 소요

- Claude Code: 6주간 미해결된 비동기 타임아웃 버그 디버깅 시 질문 기반 접근으로 근본 원인 규명, 수정 시간 20분

- Cursor(VS Code 포크): IDE 통합으로 기존 익스텐션·키바인딩·테마 자동 유지, 대규모 또는 미숙한 코드베이스 네비게이션 기능 제공

- GitHub Copilot: 이미 알고 있는 작업의 기계적 속도 향상 중심, 타입 체크가 잘된 TypeScript·Python 환경에서 최적화

- 4주 로테이션 구조: 1~2주 Claude Code → 3주 Cursor → 4주 Copilot → 마지막 2일 동일 태스크 병렬 검증

Impact

- Claude Code 리팩토링: 예상 작업량 대비 4시간 단축, 0개 버그 도입

- Claude Code 디버깅: 6주 미해결 문제 20분 해결

- Claude Code 백엔드 작업 평가: 8.5/10

- Claude Code 프론트엔드 작업 평가: 6/10

Key Takeaway

AI 코딩 어시스턴트의 효과는 기술 스택과 인터페이스 선호도에 따라 크게 달라지므로, 추론 품질이 필요한 디버깅·설계 작업과 기계적 속도가 필요한 반복 작업을 분리해 도구를 선택해야 한다.

실천 포인트

Python/TypeScript 백엔드 팀에서 복잡한 리팩토링이나 프로덕션 버그 근원 분석이 주 병목이라면 Claude Code의 터미널 기반 협업적 추론을 우선 평가하되, 팀이 IDE 통합을 선호하면 Cursor를 검토하고, 이미 GitHub Enterprise를 보유한 팀은 잘 타입화된 코드에서는 Copilot으로도 충분한지 동일 태스크로 검증 후 결정하는 것이 효과적이다.