피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

Token Usage 분석을 통한 Prompt Specification 품질 측정 및 최적화

CodeBurn y el problema que no sabía que tenía: cuántos tokens gasto por tarea real

AI 요약

Context

Claude Code의 기본 Dashboard가 제공하는 총 사용량 중심의 Billing 데이터만으로는 개별 Task의 효율성 진단이 불가능한 한계 존재. Local JSON Log의 가시성 부족으로 인한 Engineering 효율 저하 및 불필요한 Token 낭비 발생.

Technical Solution

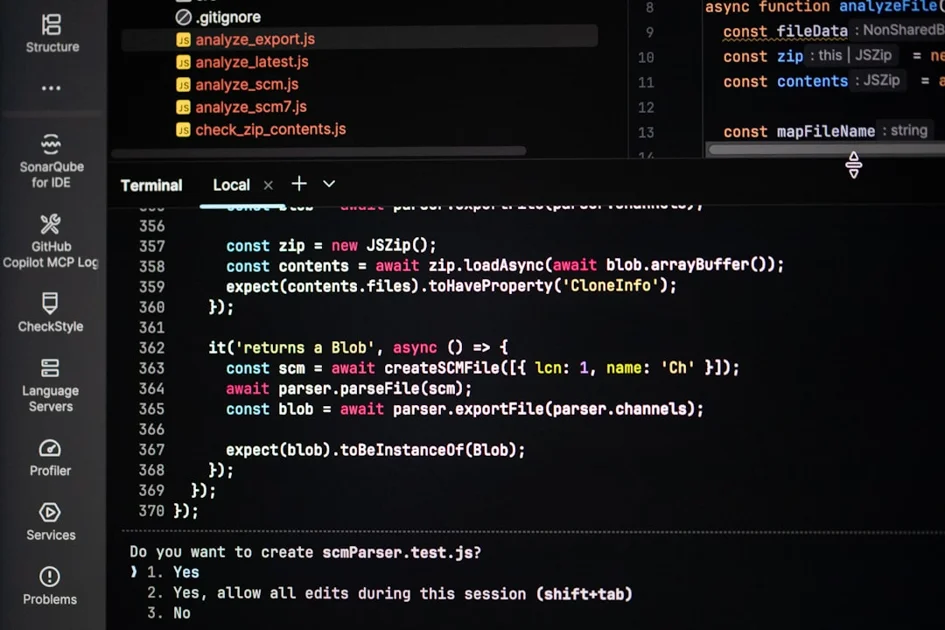

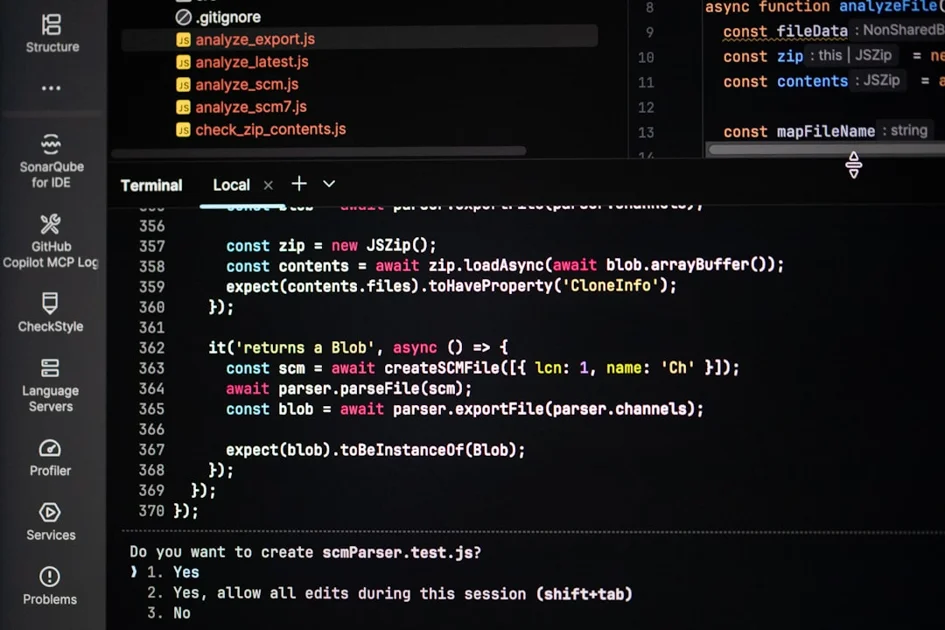

- ~/.claude/projects/ 내 Local JSON Log를 파싱하여 Session 및 Task 단위로 Breakdown하는 CLI 도구 CodeBurn 도입

- --per-task 플래그와 Atomic Commit 메시지를 연동하여 개별 기능 구현별 Token 소모량 추적

- Input/Output Token의 상관관계를 분석하여 '초기 컨텍스트 제공'과 '반복적 수정' 간의 비용 대조

- CLAUDE.md 파일 및 @file 명시적 지정으로 Agent의 불필요한 파일 탐색 및 Inference 과정 제거

- Task 복잡도 대비 Contextualization Overhead를 계산하여 AI 위임 여부를 결정하는 ROI 판단 기준 수립

실천 포인트

1. CLAUDE.md를 최신 상태로 유지하여 Agent의 불필요한 Context 탐색 최소화

2. Prompt 작성 시 Interface 및 의존성 순서를 명시적으로 제공하여 Correction Loop 방지

3. 5분 내외의 단순 작업은 Context 주입 비용이 더 크므로 수동 구현 검토

4. Atomic Commit을 통해 Task 단위의 Token 효율성을 정기적으로 모니터링