피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

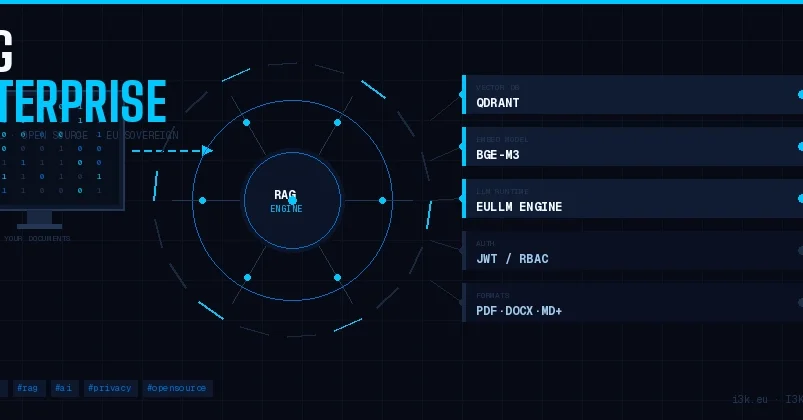

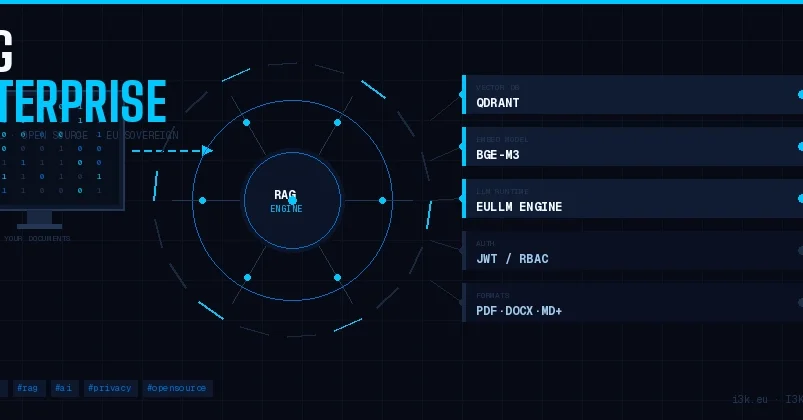

One command setup으로 완전 로컬 RAG 시스템 구축, 데이터 외부 유출 없이 10,000+ 문서 처리

I built a self-hosted RAG system that actually works — here's how to run it in one command

AI 요약

Context

기존 RAG 도구들은 클라우드 API 의존, 복잡한 자체 호스팅, 민감 문서 취급 불가 등 실제 엔터프라이즈 요구사항을 충족하지 못했다. GDPR 준수 문서, 자체 GPU 인프라 보유, SaaS 구독비 절감 등 온프레미스 운영이 필수인 환경이 존재한다.

Technical Solution

- Ubuntu 서버에 Docker + NVIDIA Container Toolkit 설치 후 ./setup.sh standard 한 줄 실행

- FastAPI 백엔드에서 LangChain RAG 파이프라인 구동, Ollama 로컬 LLM(Mistral 7B/Qwen2.5:14b)과 Qdrant 벡터DB 연동

- BAAI/bge-m3 임베딩 모델로 29개 언어 지원 및 의미론적 검색 수행

- React 프론트엔드(포트 3000)에서 JWT 인증 + RBAC 기반 역할 관리(Uploads, Queries 권한 분리)

- Apache Tika + Tesseract OCR으로 PDF/DOCX/PPTX 등 다양한 포맷 처리

Impact

RTX 4070에서 응답 시간 2~4초, 생성 속도 80~100 tokens/second 성능 제공

Key Takeaway

완전 격리된 로컬 인프라로 외부 API나 클라우드 의존성 제거 시 보안 준수와 비용 절감이 동시에 가능하며, Docker 컨테이너화로 배포 복잡도를 최소화할 수 있다.

실천 포인트

온프레미스 GPU 서버에서 Docker 기반 RAG 시스템 도입 시 ./setup.sh 실행만으로 LangChain + Ollama + Qdrant 스택 자동 구성 가능