피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

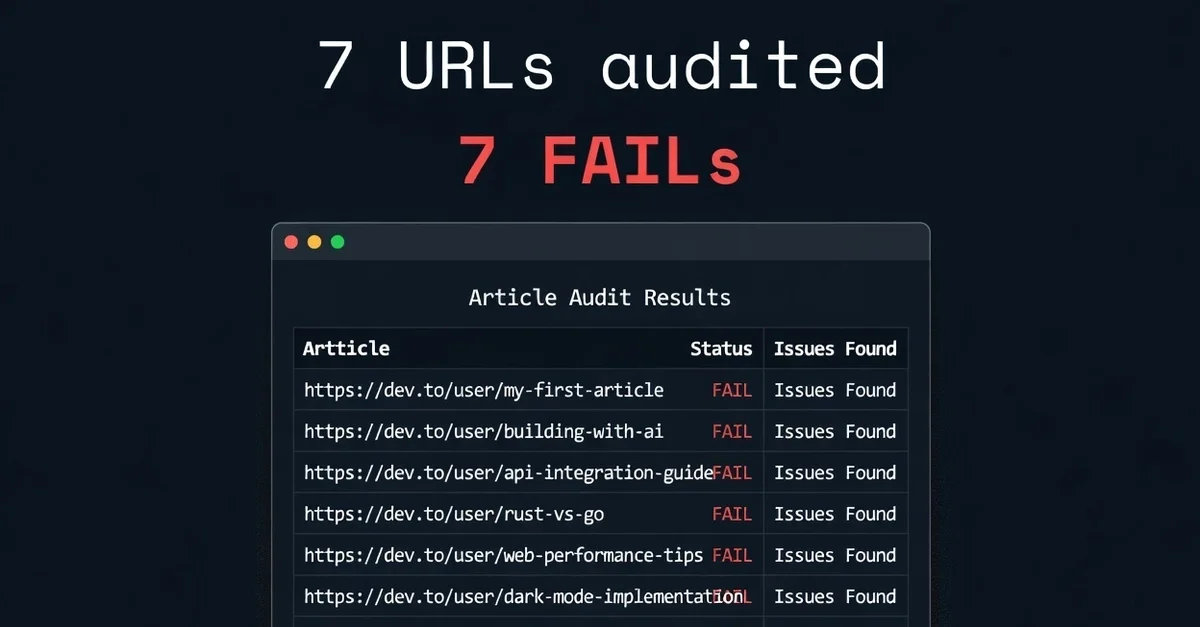

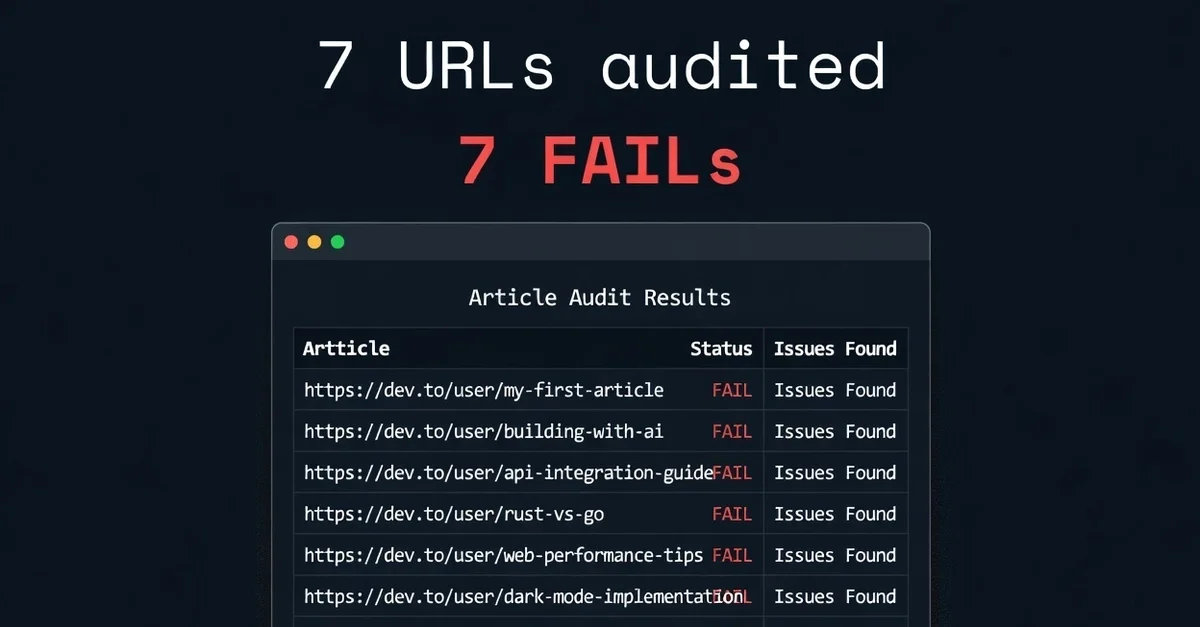

개발자가 SEO 감사 AI 에이전트를 구축하여 자가 검수를 실행한 결과, 7개 URL 전부에서 문제 발견

I Built a Local AI Agent That Audits My Own Articles. It Flagged Every Single One.

AI 요약

Context

SEO 감사는 스프레드시트에 URL을 나열하고 각 페이지의 title, description, H1, 링크 상태를 수동 확인하는 반복 작업이다. 기존 자동화 도구(Playwright, Selenium, Puppeteer)는 선택자(selector) 기반이라 페이지 CSS 클래스 변경 시 즉시 파손된다.

Technical Solution

- Browser Use로 Chromium 창에서 실제 페이지 렌더링 후 페이지 스냅샷 캡처

- Claude Sonnet API 호출 시 구조화된 JSON 반환 (title 상태, description 상태, H1 개수, canonical 태그, 플래그)

- httpx 비동기 HEAD 요청으로 URL당 최대 50개 링크 동시 검사 (5초 타임아웃)

- Flat JSON 파일(state.json)로 감사 진행 상태 추적, 중단 후 재개 가능

- HITL(Human-in-the-Loop) 모듈: 200이 아닌 상태코드, 로그인 리다이렉트, 접근 거부 감지 시 대화형 결정 또는 자동 스킵

Impact

URL당 약 $0.002 비용 발생. 20개 URL 주간 감사의 경우 $0.05 미만.

Key Takeaway

브라우저 자동화의 취약점이 선택자(selector)에서 프롬프트(prompt)로 이동했다. 페이지 구조가 바뀌어도 의미론적 해석은 동작하므로 유지보수 부담이 줄어든다.

실천 포인트

SEO 감사 워크플로우에서 Browser Use와 Claude Sonnet 기반 의미론적 페이지 분석을 조합하면, 선택자 의존성 없이 페이지 변경에도 안정적으로 메타데이터 검증을 자동화할 수 있다.