피드로 돌아가기

Dev.toDevOps

Dev.toDevOps

원문 읽기

Ollama를 로컬 실행에서 Docker Desktop 기반으로 마이그레이션해 GPU 가속을 활성화하고 추론 속도 개선

🚀 Fixing Ollama Not Using GPU with Docker Desktop (Step-by-Step + Troubleshooting)

AI 요약

Context

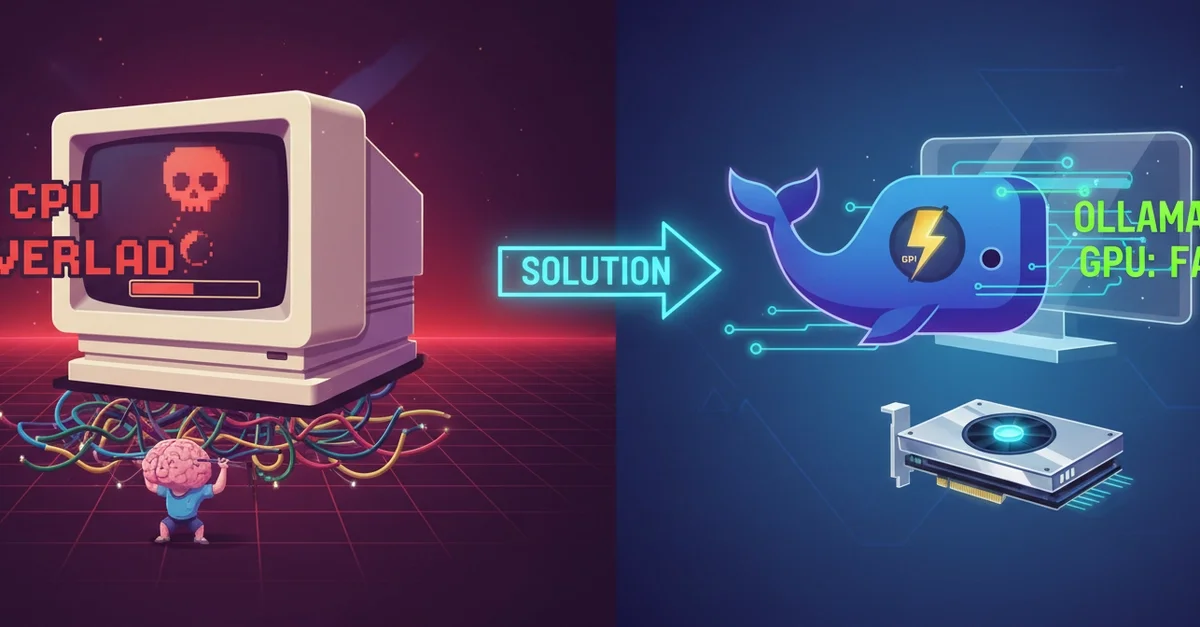

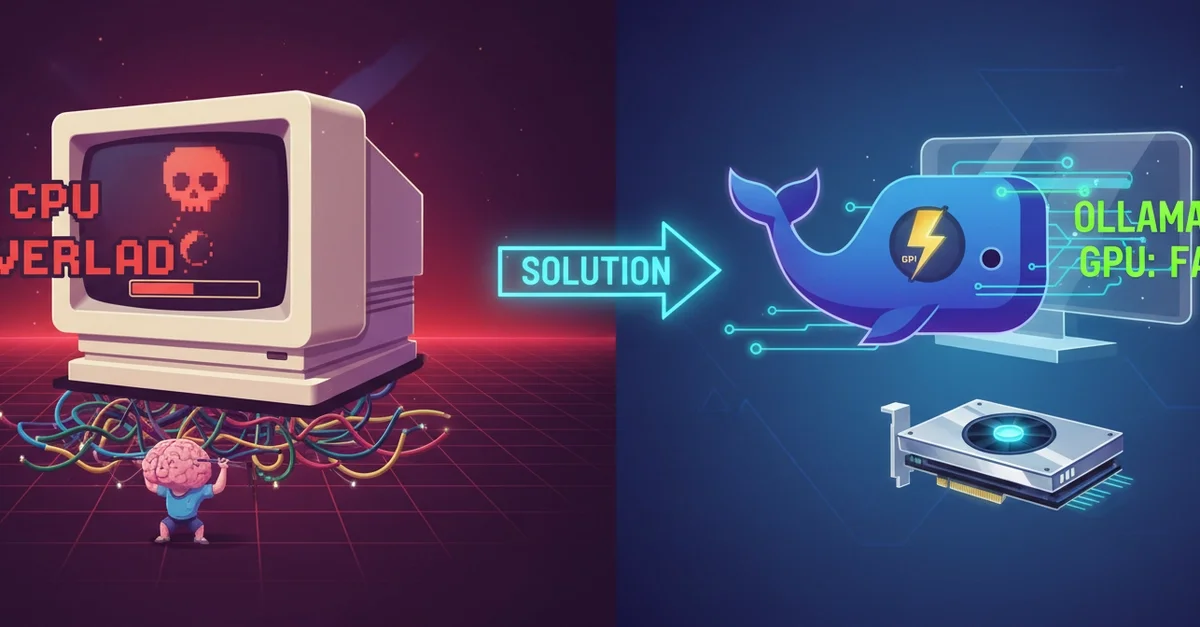

Ollama를 로컬 환경에 설치하고 LLM 모델을 실행했지만 GPU가 인식되지 않아 CPU 기반 처리로 인한 느린 응답 속도와 높은 CPU 사용률이 발생했다. 동일한 GPU가 Docker 컨테이너 내에서는 정상 작동했으므로, 문제는 로컬 환경의 GPU 접근성 설정에 있었다.

Technical Solution

- Ollama 컨테이너를 Docker Desktop 위에서

--gpus all플래그로 실행: GPU 메모리와 연산 리소스를 컨테이너에 직접 할당 - 사전 검증 단계 추가:

docker run --rm --gpus all nvidia/cuda:12.2.0-base-ubuntu22.04 nvidia-smi명령으로 Docker의 GPU 접근성을 먼저 확인 - Ollama 볼륨 마운트:

-v ollama:/root/.ollama로 모델 데이터 영속성 보장 - API 기반 모델 실행: 컨테이너 진입 대신 localhost:11434 엔드포인트를 통해 curl로 요청 처리

- 실시간 모니터링: 추론 중 호스트에서

nvidia-smi실행으로 GPU 메모리 사용량 확인

Impact

GPU 메모리 사용량이 모델 실행 중 증가 확인, 추론 속도 향상 달성.

실천 포인트

로컬 GPU 할당 문제로 LLM 추론이 느린 환경에서는 Docker Desktop을 WSL2 및 최신 NVIDIA 드라이버와 함께 구성한 후 `--gpus all` 플래그로 컨테이너를 실행하면 로컬 디버깅 시간 절약과 GPU 가속 확보 가능.