피드로 돌아가기

GeekNewsFrontend

GeekNewsFrontend

원문 읽기

Show GN: Garu: 브라우저에서 돌아가는 1.7MB 한국어 형태소 분석기 (F1 95.3%, WASM)

개발자가 코드북과 Viterbi 알고리즘으로 신경망 없이 브라우저에서 실행되는 1.7MB 한국어 형태소 분석기를 구현하여 95.3%의 정확도를 달성했다

AI 요약

Context

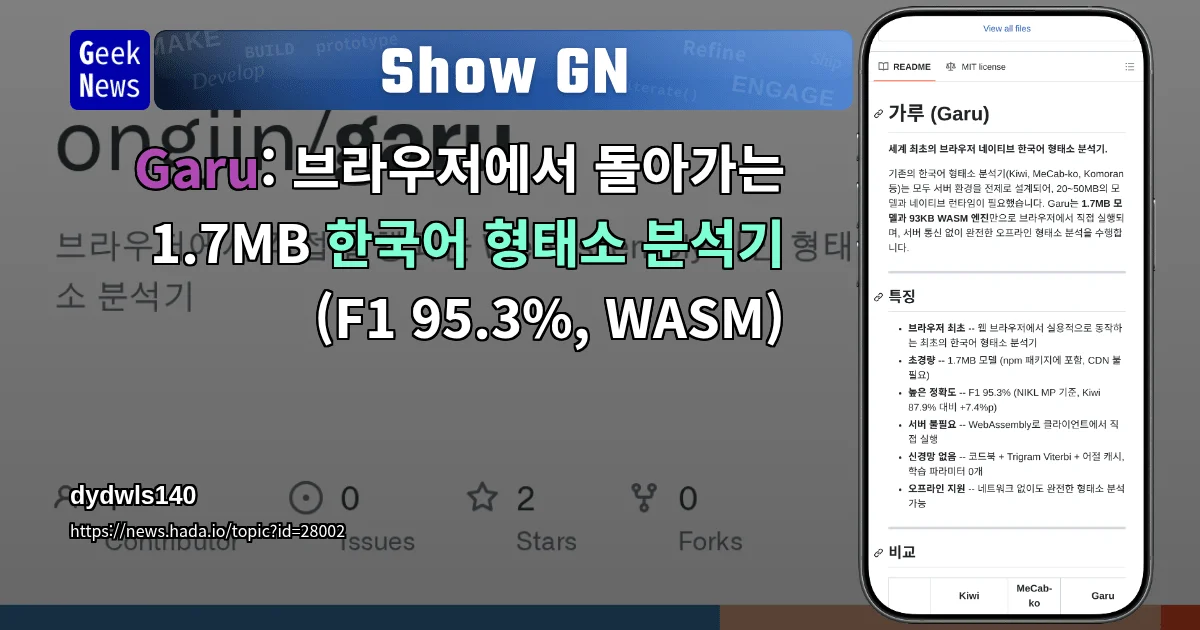

기존 Kiwi, MeCab-ko 형태소 분석기는 서버 환경에 최적화되어 있어서 크기가 40~50MB에 달한다. 클라이언트 사이드에서 경량 형태소 분석이 필요한 경우 선택지가 없었다.

Technical Solution

- 한국어 말뭉치의 핵심 어휘를 코드북으로 압축하여 1.7MB 모델 크기를 달성했다

- 순수 룩업과 Viterbi 디코딩만으로 신경망 없이 형태소 분석을 수행한다

- 93KB WASM 엔진을 통해 브라우저에서 네이티브 수준의 실행 성능을 확보했다

- BiLSTM 지식 증류와 자소 단위 시퀀스 라벨링 실패 후 코드북 기반 아키텍처로 전환했다

- NIKL 골드 데이터 직접 학습과 문맥 기반 후처리 규칙으로 정확도를 향상시켰다

Impact

모델 크기가 기존 대비 약 96% 감소했다(50MB → 1.7MB). 정확도는 Kiwi 87.9%, MeCab-ko 85% 대비 95.3%로 향상되었다.

Key Takeaway

신경망이 아닌 전통적인 알고리즘으로도 특정 태스크에서 경쟁력 있는 성능을 달성할 수 있다.

실천 포인트

브라우저 환경에서 한국어 텍스트를 처리할 때 코드북과 Viterbi 기반의 비신경망 아키텍처를 적용하면 서버 의존 없이 1.7MB 미만의 가벼운 형태소 분석기를 구현할 수 있다