피드로 돌아가기

GeekNewsAI/ML

GeekNewsAI/ML

원문 읽기

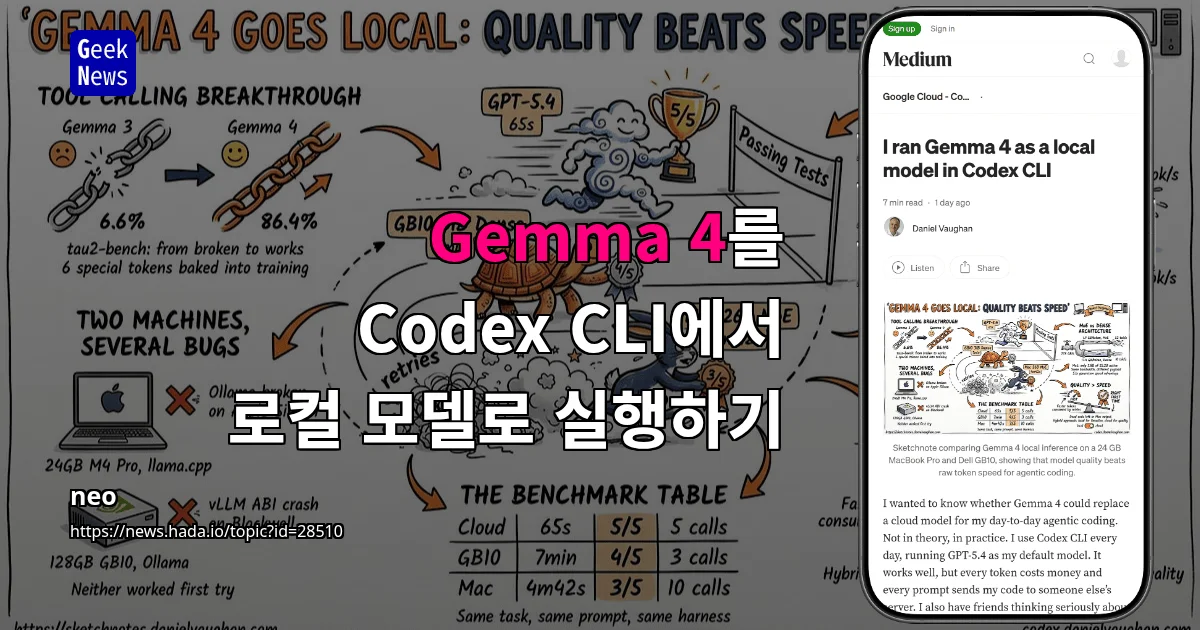

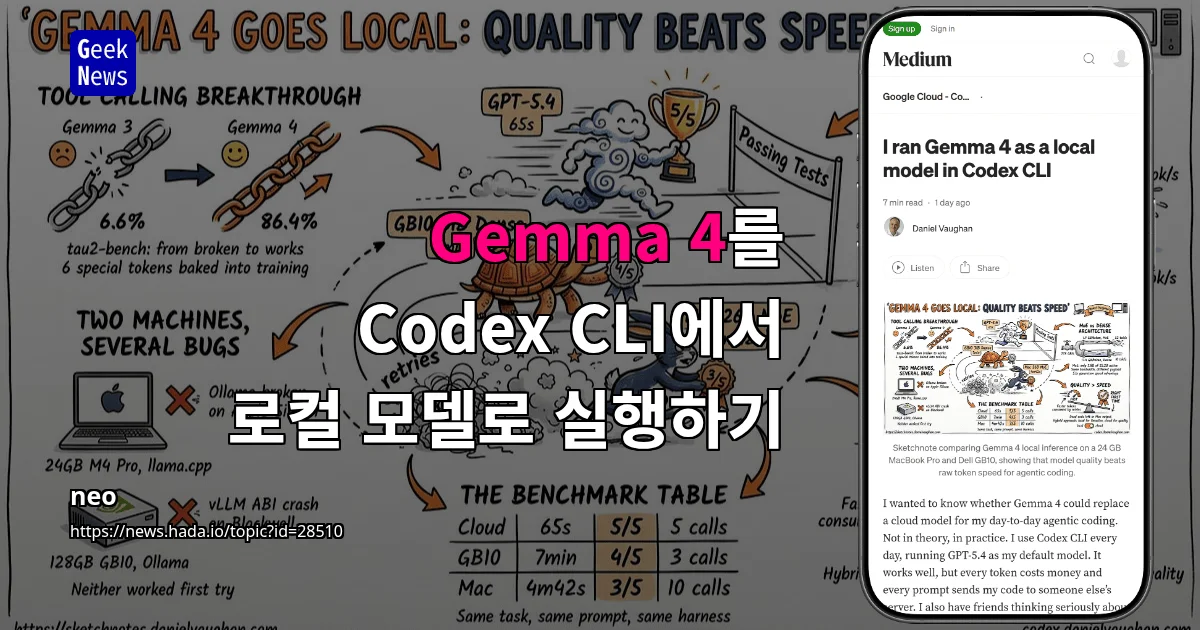

Gemma 4를 Codex CLI에서 로컬 모델로 실행하기

H100 2장 기반 Gemma4-31B 도입을 통한 추론 효율 최적화

AI 요약

Context

고성능 추론을 위해 GPT-OSS-120B 및 Qwen3.5-35B-A3B 모델을 순차적으로 검토한 이력 존재. 대규모 파라미터 모델의 높은 리소스 점유율과 응답 지연 시간을 해결하기 위한 경량 고효율 모델 탐색 필요.

Technical Solution

- H100 GPU 2장을 활용한 Gemma4-31B 모델의 로컬 인프라 배포

- 파라미터 규모 최적화를 통한 응답 속도 향상 및 시스템 반응성 확보

- Tool Use 판단 및 결과 정리 능력을 검증하여 워크플로우 자동화 적용

- 모델 교체 전략을 통한 추론 비용 절감 및 처리 효율 극대화

- 한국어 처리 성능 검증을 통한 도메인 적합성 확보

실천 포인트

1. 추론 속도와 응답 품질의 Trade-off를 분석하여 서비스 요구사항에 맞는 적정 파라미터 규모 선정

2. H100 등 고성능 GPU 가용 자원에 따른 최적의 모델 사이즈 매핑 검토

3. LLM의 Tool Use 능력을 실제 워크플로우에 적용하여 자동화 가능 여부 사전 검증