피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

Rewind 도입으로 LLM 에이전트 디버깅 비용 77% 절감 및 검증 자동화

I use Langfuse for tracing. Here's why I added Rewind for debugging.

AI 요약

Context

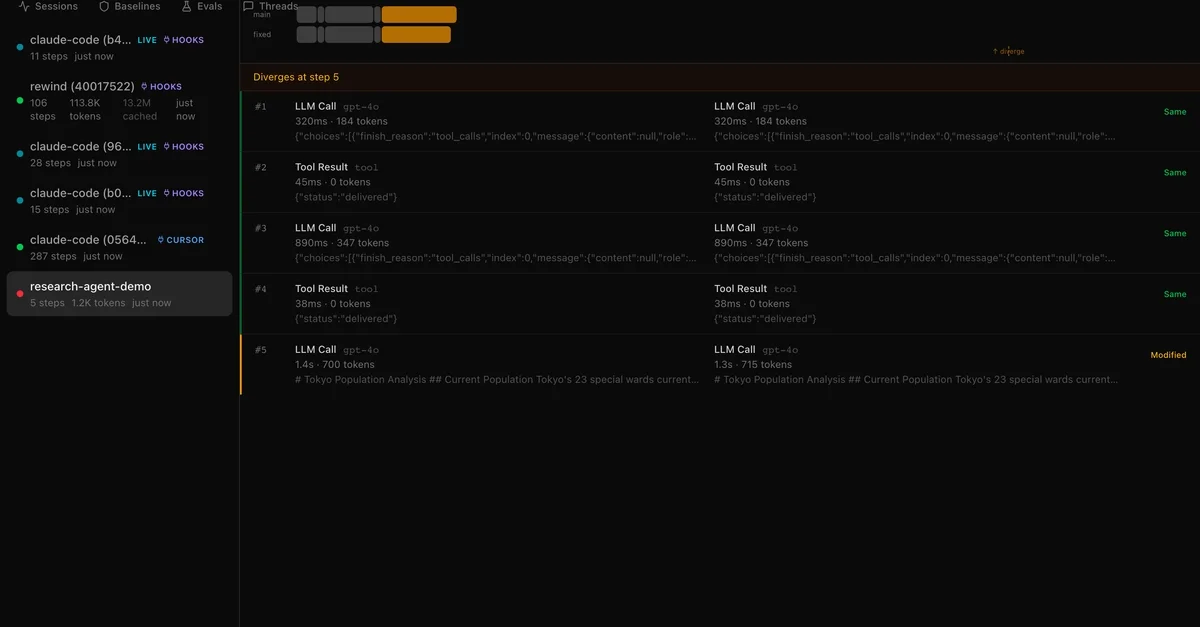

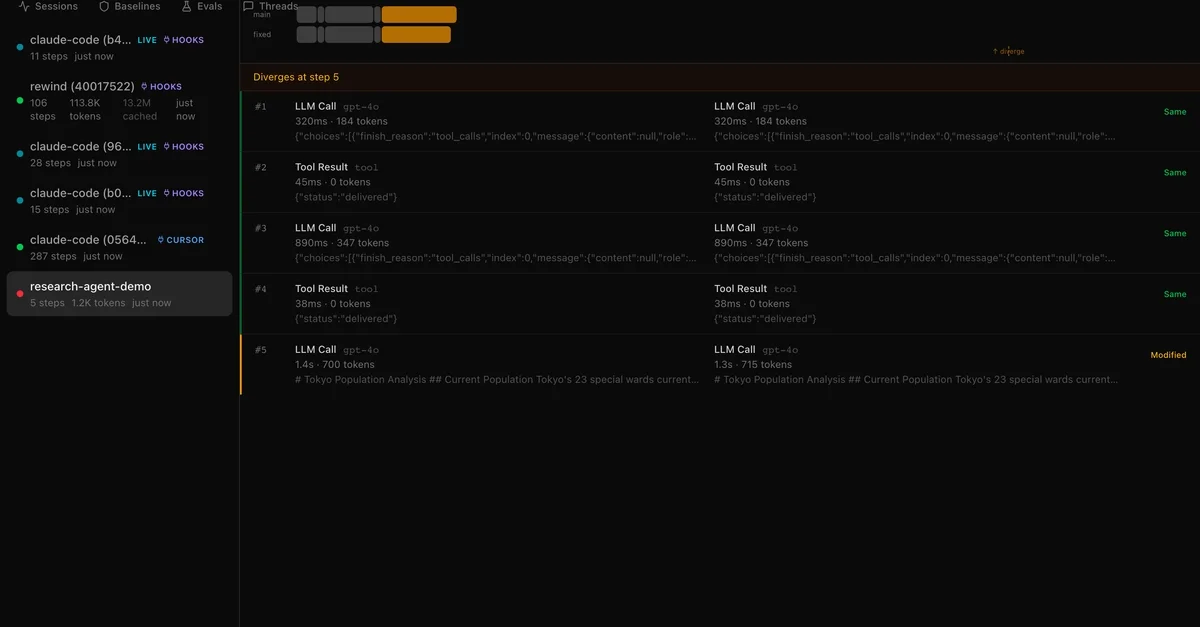

Langfuse 등 기존 Observability 도구는 실행 결과 기록(Tracing)에 특화되어 있어, 특정 단계의 실패를 수정하기 위해 전체 워크플로우를 재실행해야 하는 비효율 발생. LLM의 Non-deterministic 특성으로 인한 재현 불가능 문제와 반복적인 API 호출에 따른 비용 및 시간 낭비가 주요 병목 지점으로 작용.

Technical Solution

- Langfuse REST API 연동을 통한 기존 Trace 데이터의 로컬 SQLite 마이그레이션 구조 설계

- 특정 단계에서 실행 흐름을 분기하는 Forking 매커니즘 구현을 통한 부분 재실행 지원

- 이전 단계의 응답을 로컬 캐시에서 반환하는 Cache-hit 로직을 통해 Upstream API 호출 제거

- LLM-as-judge 기반의 Evaluator를 도입하여 수정 전후 타임라인의 정량적 Correctness 비교 분석

- OpenTelemetry(OTEL) 표준 포맷 기반의 Export 기능을 통해 디버깅 결과를 다시 관찰 도구로 전송하는 Feedback Loop 구축

실천 포인트

- LLM 체인 설계 시 단계별 입출력을 캐싱하여 재실행 비용을 최소화하는 구조 검토 - 단순 로그 확인이 아닌 LLM-as-judge를 활용한 정량적 회귀 테스트 자동화 도입 - 로컬 디버깅 환경과 클라우드 관찰 도구 간의 데이터 상호 운용성(OTEL 등) 확보