피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

Model-free 학습으로 구현하는 FrozenLake 최적 경로 탐색

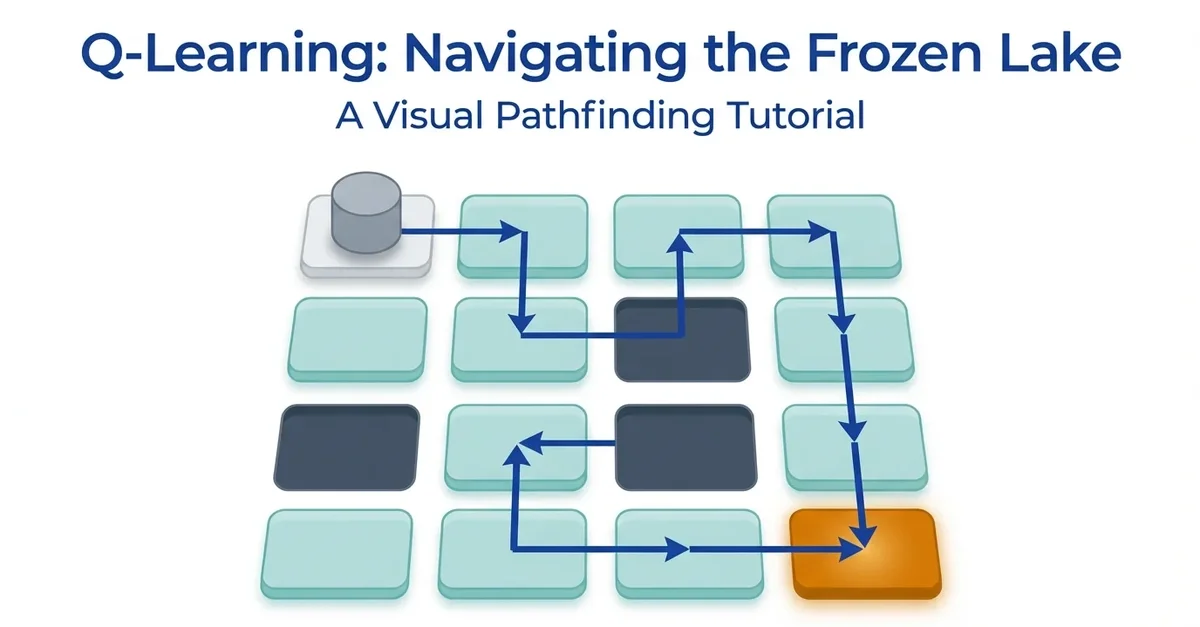

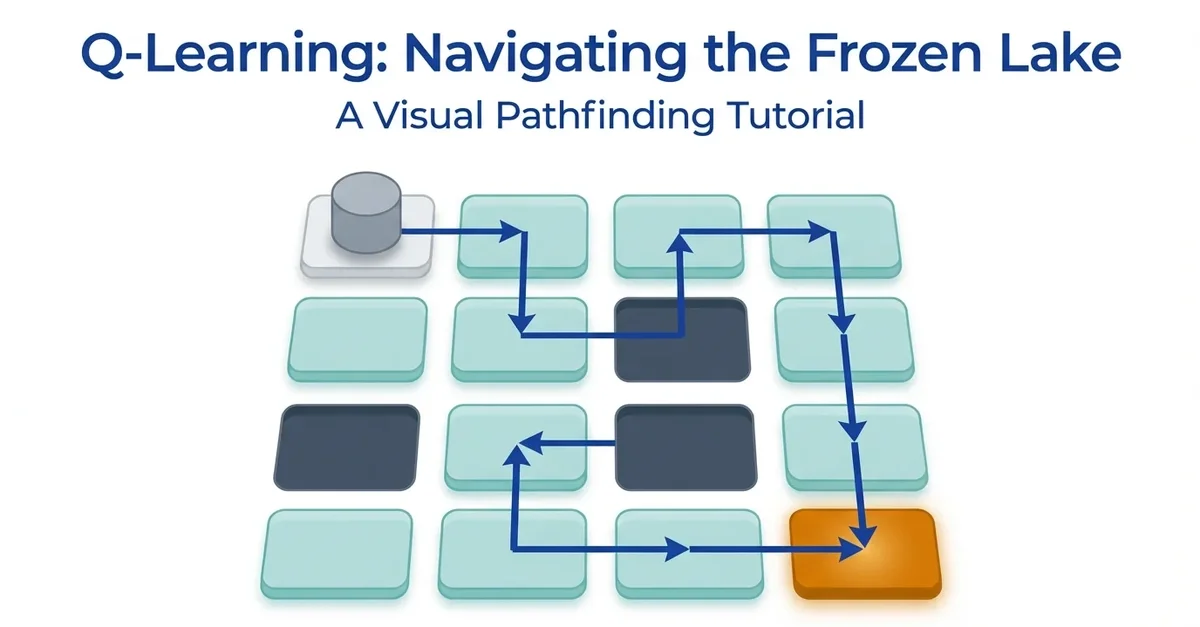

Q-Learning from Scratch: Navigating the Frozen Lake

AI 요약

Context

환경에 대한 사전 정보가 없는 Model-free 상황에서의 경로 최적화 문제. 이동 방향의 불확실성이 존재하는 Stochastic 환경으로 인한 학습 난이도 상승. 보상 체계가 목표 도달 시에만 발생하는 Sparse Reward 구조의 한계.

Technical Solution

- State-Action 쌍의 가치를 저장하는 Q-table 기반의 Lookup Table 설계

- Bellman Equation을 활용해 현재 예측값과 실제 보상을 반영하는 Temporal Difference 업데이트 로직 구현

- 탐색과 활용의 균형을 위해 Epsilon-greedy 전략을 도입하고 학습 진행에 따라 Epsilon 값을 지수적으로 감소시키는 Decay 방식 적용

- 미래 보상의 현재 가치를 결정하는 Discount Factor(gamma)를 0.99로 설정하여 장기적 관점의 경로 계획 수립

- 연속적 상태 공간의 한계를 극복하기 위해 Neural Network를 활용하는 Deep Q-Networks(DQN)로의 확장 가능성 제시

Impact

- 20,000회 에피소드 학습 후 약 67%의 Goal 도달 성공률 달성

- 환경의 확률적 특성을 고려한 이론적 최대 성공률인 74%에 근접한 Near-optimal 정책 도출

Key Takeaway

환경의 동역학을 모르는 상태에서도 보상 기반의 반복적 업데이트를 통해 최적 정책을 수립할 수 있는 강화학습의 기본 원리 확인.

실천 포인트

상태 공간이 방대하거나 연속적인 환경에서는 Tabular Q-learning 대신 DQN과 같은 함수 근사기(Function Approximator) 도입을 검토할 것