피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

47줄의 Python 코드로 구현한 Rate Limit 대응형 LLM 파이프라인

How I Built a Keyword-to-Blog-Post Pipeline in Python (Under 50 Lines)

AI 요약

Context

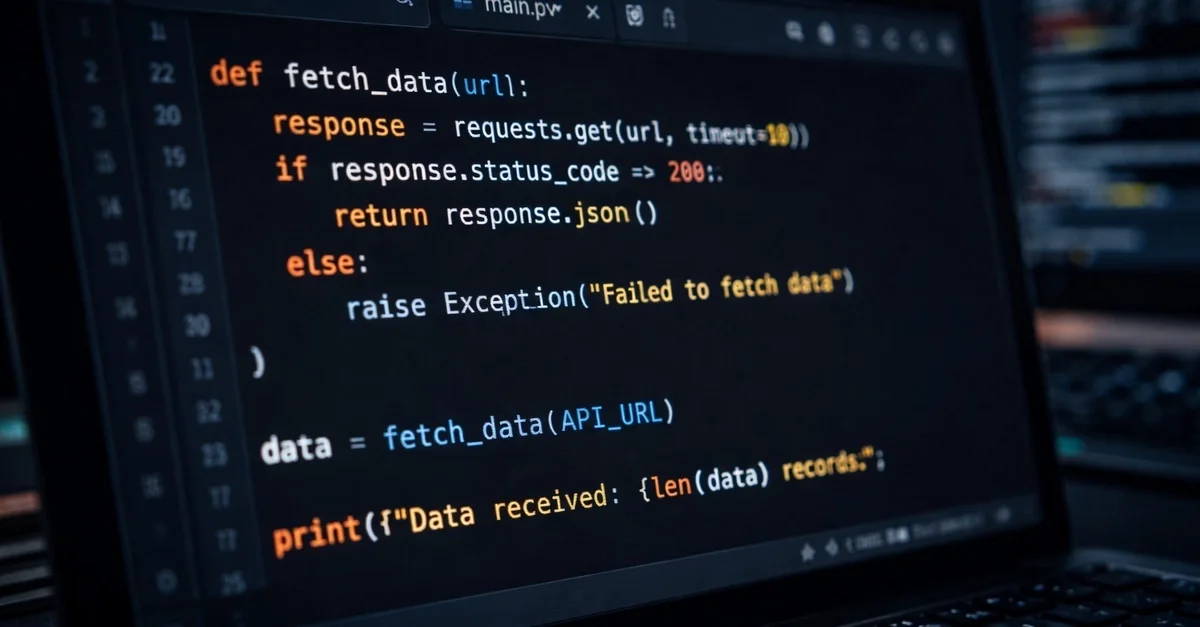

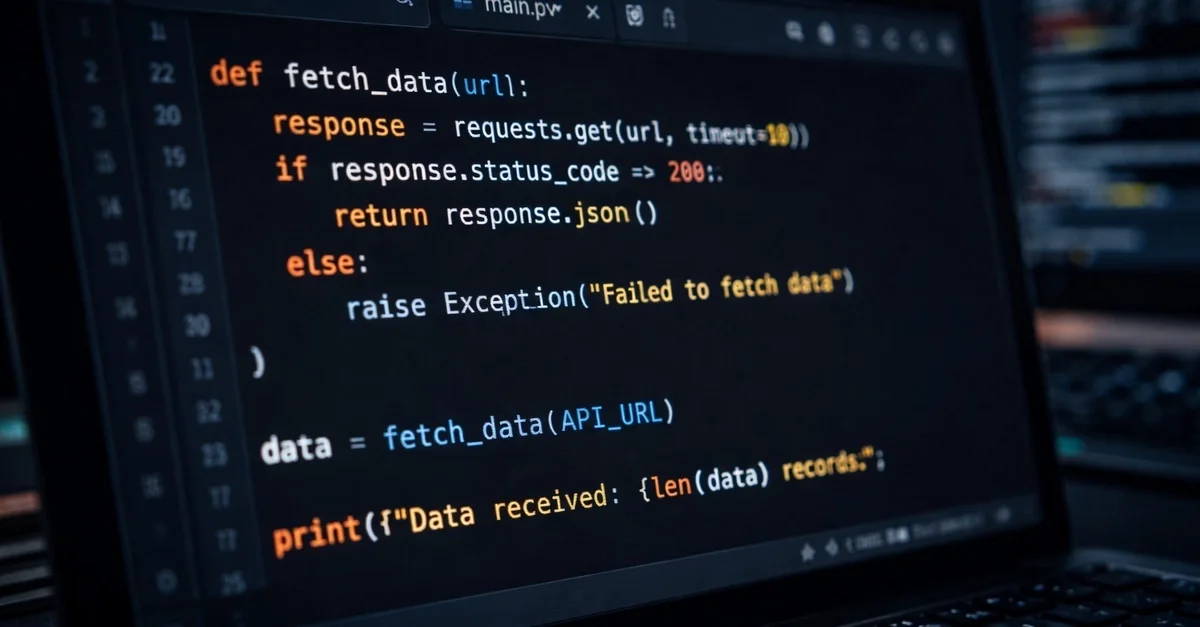

단순 API 호출 방식의 LLM 스크립트는 Rate Limit 발생 시 전체 프로세스가 중단되는 취약점 존재. 비정형 응답으로 인한 데이터 일관성 결여와 중간 실패 시의 데이터 손실 가능성이 주요 병목 지점으로 분석됨.

Technical Solution

- Structured Prompt Template 설계를 통한 응답 구조 표준화 및 예측 가능성 확보

- Exponential-ish Backoff 전략을 적용한 Retry 로직으로 RateLimitError의 안정적 처리

- File-based Persistence 방식을 통한 작업 상태 유지 및 중단 지점부터의 Resume 기능 구현

- API 할당량 준수를 위한 정적 Sleep interval(22s) 도입으로 요청 빈도 제어

- Slugify 함수를 통한 키워드 기반 파일명 정규화 및 OS 파일 시스템 호환성 확보

실천 포인트

- API Rate Limit 정책에 맞춘 Sleep 간격 및 최대 재시도 횟수 설정 검토 - 중복 작업 방지를 위해 파일 존재 여부나 DB 상태를 확인하는 체크포인트 로직 구현 - LLM 응답의 일관성을 위해 구체적인 섹션 구조와 제약 조건을 명시한 Prompt Template 적용 - 파일 시스템 저장 시 특수문자 제거를 위한 정규화 로직 포함 여부 확인