피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

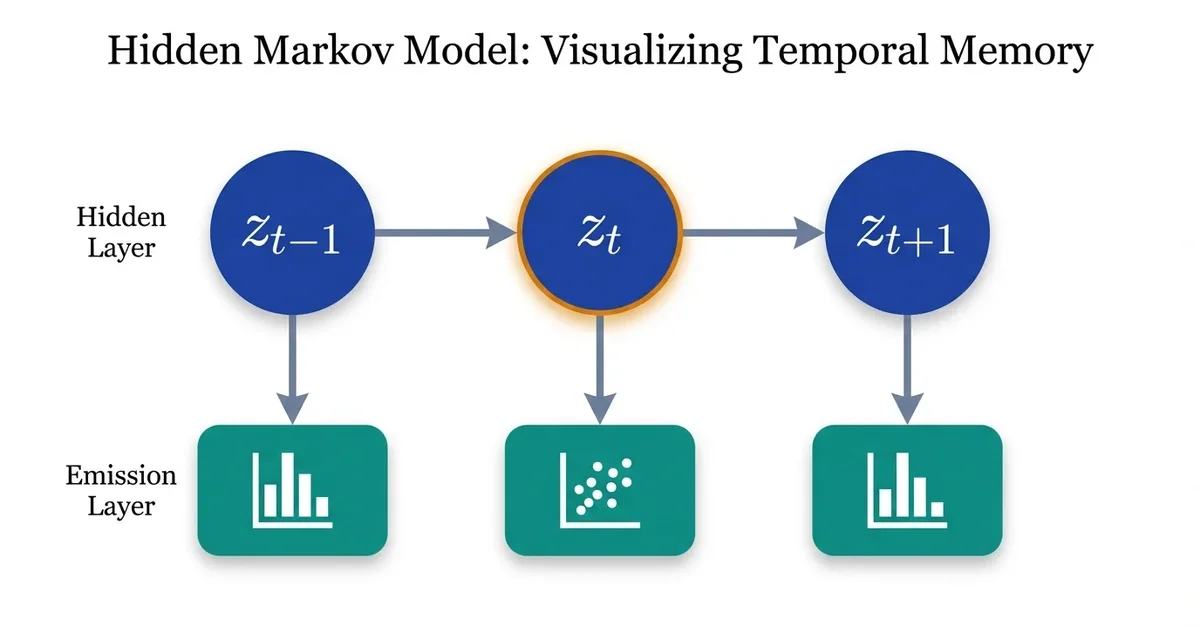

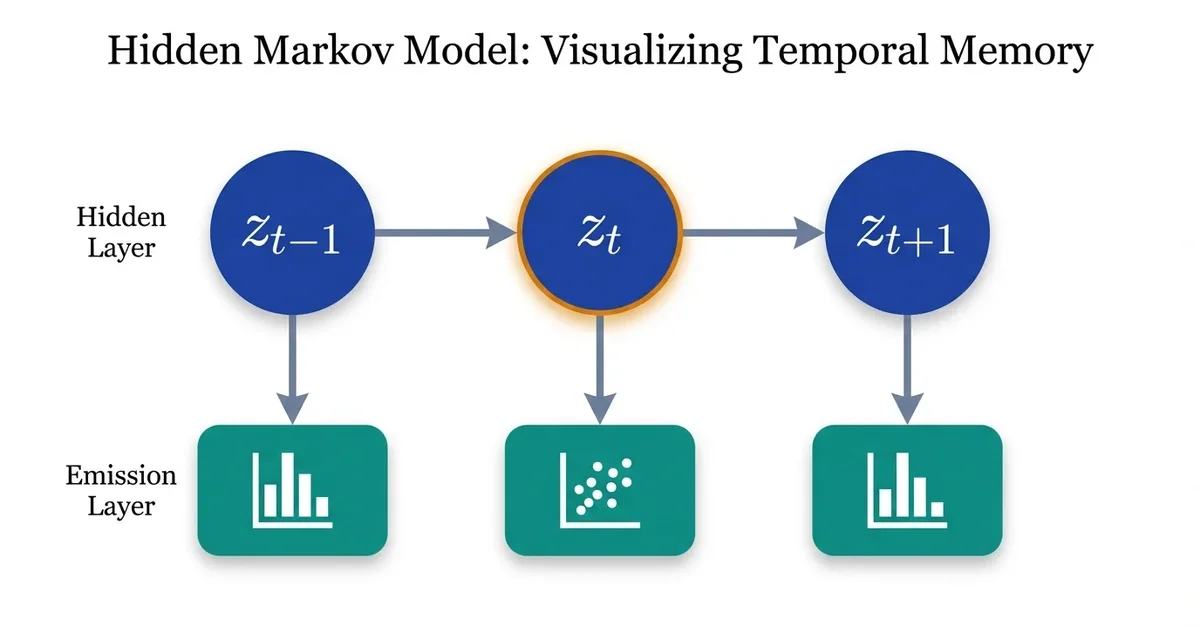

Hidden Markov Models가 시계열 데이터의 숨겨진 상태 전이를 Forward와 Viterbi 알고리즘으로 추적하는 구조를 설명합니다

Hidden Markov Models: When Clusters Have Memory

AI 요약

Context

K-Means와 GMM은 관측값 간의 독립성을 가정하여 각 데이터 점을 개별적으로 분석합니다. 시계열 데이터에서는 현재 상태가 과거 상태에 의존하므로 이 가정이 타당하지 않습니다.

Technical Solution

- [Markov Chain] → [전이 확률 행렬 A를 정의하여] [다음 상태가 현재 상태에만 의존하는 Markov 성질을 구현]

- [HMM] → [전이 행렬 A, 방출 확률 B, 초기 분포 π를 파라미터로 설정하여] [숨겨진 상태와 관측값 간의 관계를 모델링]

- [Forward Algorithm] → [α_t(i) 순방향 변수를 재귀적으로 계산하여] [관측 시퀀스의 우도 P(O|λ)를 산출]

- [Viterbi Algorithm] → [합(summation) 대신 최대(max) 연산으로 동적 프로그래밍을 적용하여] [가장 가능성 높은 숨겨진 상태 시퀀스를 복원]

- [정규화] → [log 변환을 적용하여] [숫자 언더플로우 문제를 회피]

Impact

동일 데이터셋에서 K-Means 대비 HMM이 regime switch 발생 빈도를 5배 감소시킵니다.

Key Takeaway

시간적 의존성이 존재하는 데이터에서는 관측값의 직접적 군집화 대신 숨겨진 상태 전이 메커니즘을 모델링해야 합니다.

실천 포인트

주식 시장 regime 탐지에서 Gaussian HMM을 활용하면 관측 노이즈 속에서도 진정한 regime 전환을 구분할 수 있습니다