피드로 돌아가기

Dev.toBackend

Dev.toBackend

원문 읽기

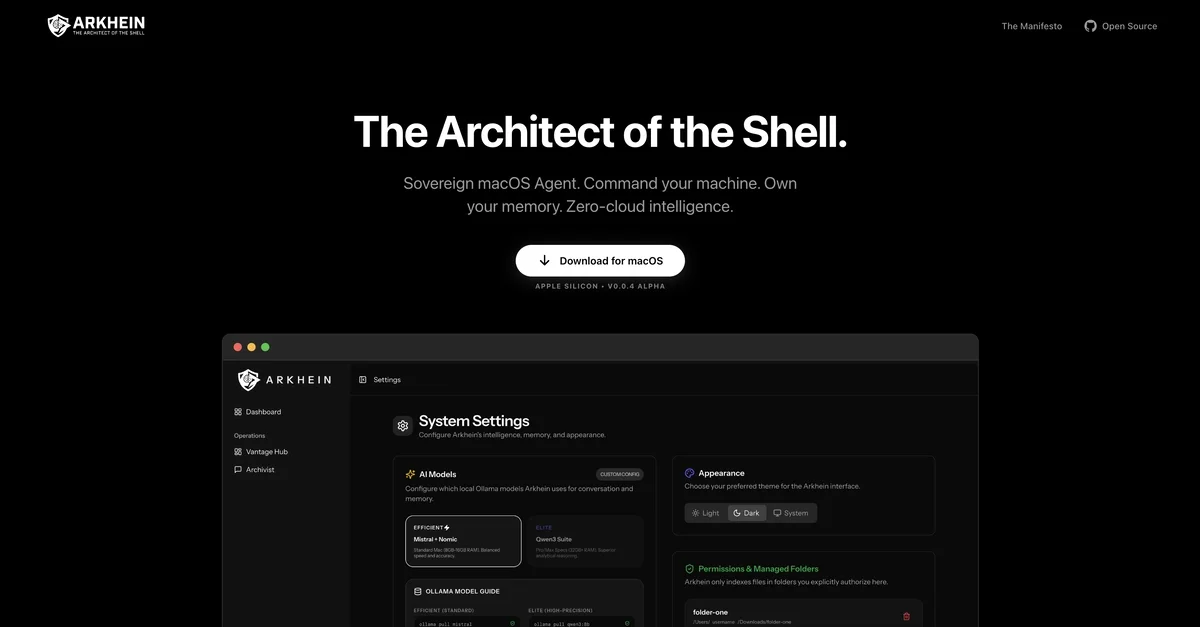

Arkhein이 로컬 추론 엔진으로 클라우드 의존성을 제거하고 사용자 데이터를 기기 내부에 격리

Arkhein: Command Your Silicon. Own Your Memory.

AI 요약

Context

기존 AI 도구들은 쿼리를 원격 서버로 전송하고 모델 학습에 사용자 데이터를 활용하며 플랫폼이 데이터를 보유하는 구조였다. 사용자는 데이터 소유권과 프라이버시를 명시적으로 양도하는 트레이드오프를 감수해야 했다.

Technical Solution

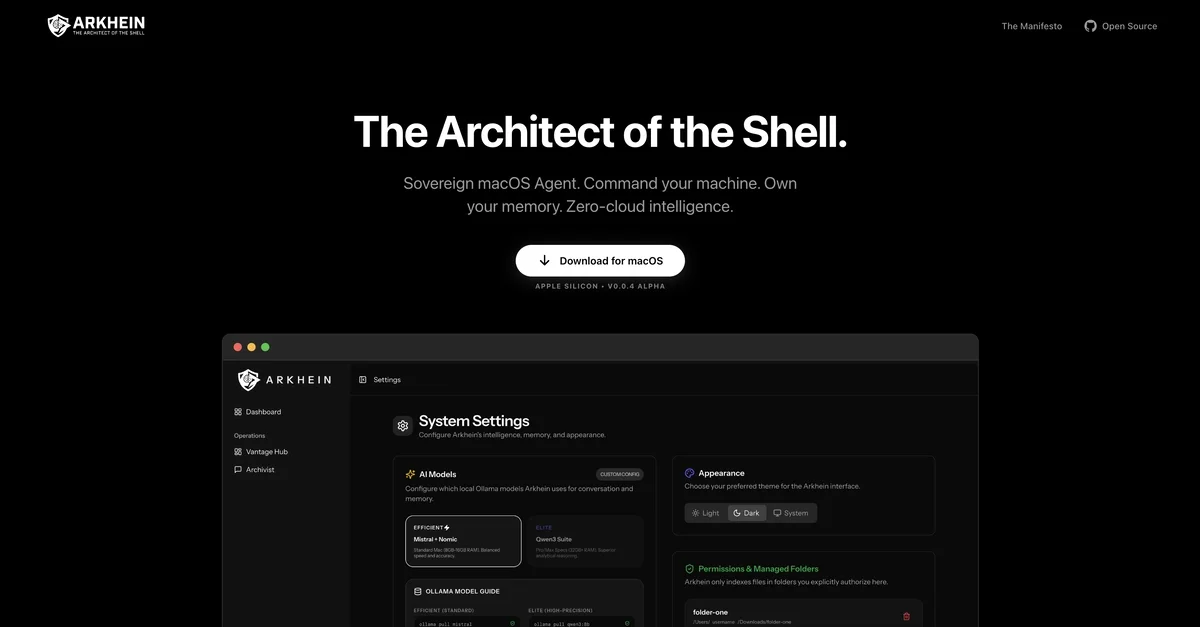

- 로컬 추론을 Ollama로 구현: macOS 기기에서 Mistral 또는 Qwen3 모델을 실행하며 외부 API 호출 제거

- 계층적 지식 구조 도입: 폴더(Silo) → 문서(Vessel) → 청크(Fragment) 구조로 주제 격리를 100% 달성하고 Parent-Aware RAG로 검색 전에 문서 요약·폴더 깊이 파악

- 다단계 쿼리 분류 엔진 구축: JSON 기반 Dispatcher가 검색·종합·파일시스템 명령·창작 생성을 의도별로 라우팅하기 전에 쿼리 의도 분류

- 자가 복구 메모리 아키텍처 구성: SQLite를 단일 정보원으로, Vektor를 벡터 인덱스 가속화층으로 사용하며 차원 불일치 시 자동 감지하고 shadow partition으로 무중단 재구축

- 사용자 승인 기반 파일시스템 제어: /create, /move, /organize, /delete 명령이 실행 전 사용자 검증을 거치는 Human-in-the-Loop 모델 적용

Impact

아티클에 정량적 수치가 제시되지 않았습니다.

Key Takeaway

로컬 우선 AI 아키텍처는 데이터 주권 보장과 클라우드 의존성 제거를 동시에 달성할 수 있다. 계층화된 지식 구조와 의도 기반 라우팅은 대규모 문서 환경에서 주제 격리와 검색 정확도를 함께 높이는 설계 패턴이다.

실천 포인트

로컬 LLM 기반 애플리케이션을 구축하는 팀에서 Vektor와 SQLite 조합으로 무중단 벡터 인덱스 재구축을 구현하면 모델 변경 시 서비스 중단 없이 차원 불일치를 자동 복구할 수 있다. 또한 Parent-Aware RAG를 적용하면 검색 전에 문서 메타데이터를 미리 파악해 주제 간 오염을 방지하고 정확도를 높일 수 있다.