피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

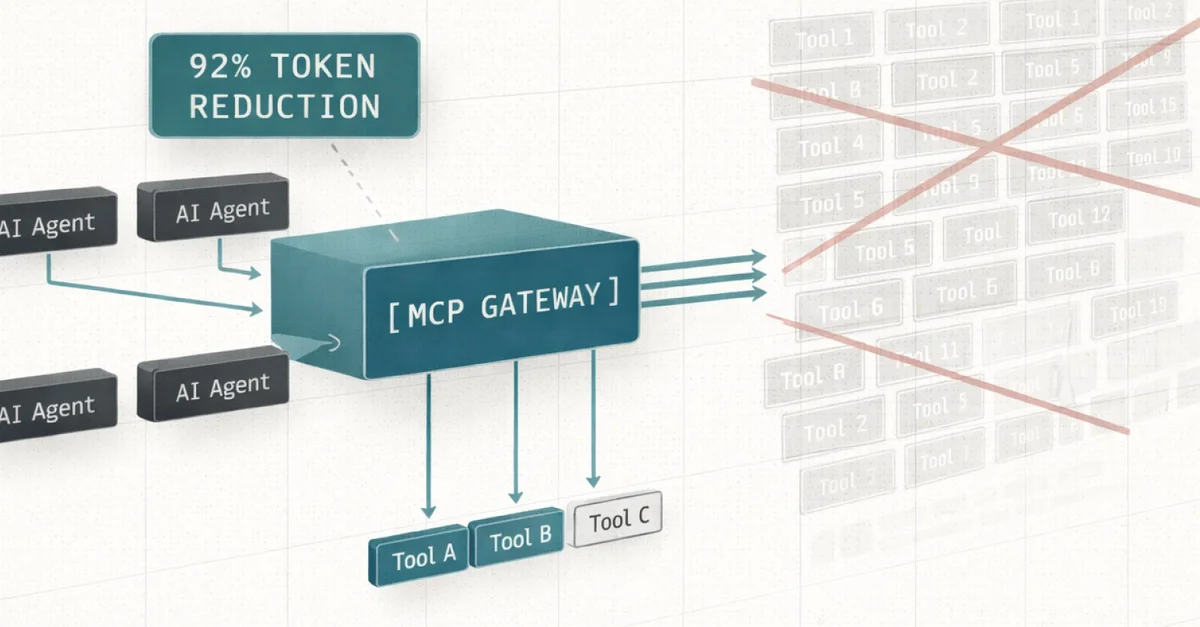

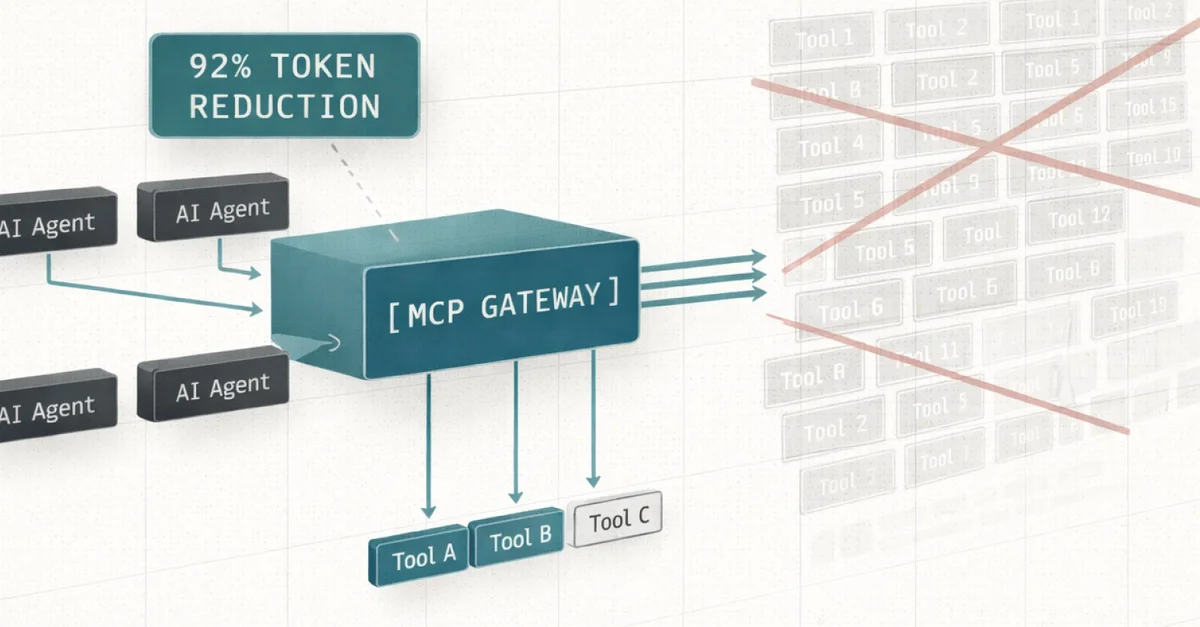

Code Mode 도입을 통한 MCP Token 비용 92% 절감 및 고성능 게이트웨이 설계

How Bifrost's MCP Gateway Cuts AI Agent Token Costs by 92% Without Sacrificing Capability

AI 요약

Context

기존 MCP 아키텍처는 모든 Tool Definition을 매 요청마다 모델 Context에 주입하는 구조로 인한 토큰 낭비 발생. 연결 서버와 도구 수가 증가함에 따라 프롬프트 시작 전 소모되는 토큰 비용이 기하급수적으로 상승하는 병목 지점 확인.

Technical Solution

- 모든 Tool Definition 주입 방식에서 필요한 정보만 호출하는 On-demand 구조로 전환

- MCP 서버를 가상 파일 시스템 형태의 Python stub 파일로 노출하여 Context 부하 최소화

- 모델이 Meta-tools를 통해 필요한 서버 정보 조회 및 Python 기반 오케스트레이션 스크립트 작성

- 작성된 스크립트를 샌드박스화된 Starlark Interpreter에서 실행하여 보안성 및 격리성 확보

- Go 언어 기반 구현을 통해 5,000 RPS 환경에서 11ms 수준의 극소한 오버헤드 달성

- LLM 라우팅과 MCP 실행을 단일 레이어에서 처리하는 통합 게이트웨이 아키텍처 설계

실천 포인트

1. 다수의 Tool을 사용하는 에이전트 설계 시 Context에 모든 명세를 포함하고 있는지 검토

2. 정적 명세 주입 대신 Meta-tool을 통한 동적 명세 로딩 구조 도입 고려

3. LLM 오케스트레이션 코드 실행 시 보안을 위해 Starlark와 같은 샌드박스 런타임 적용 검토

4. 성능 임계치가 중요한 게이트웨이 설계 시 Go와 같은 컴파일 언어를 통한 저지연 아키텍처 채택