피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

Token Usage 분석을 통한 Prompt Specification 품질 측정 및 최적화

CodeBurn y el problema que no sabía que tenía: cuántos tokens gasto por tarea real

AI 요약

Context

Claude Code의 기본 대시보드가 제공하는 전체 Token 사용량 지표는 Billing 확인 용도로는 적합하나, 구체적인 작업 단위의 병목 지점을 파악하기에는 분석 밀도가 낮음. 특히 작업별 세부 소모량 추적이 불가능하여 비효율적인 Prompting 패턴과 Context 누수를 식별하기 어려운 한계가 존재함.

Technical Solution

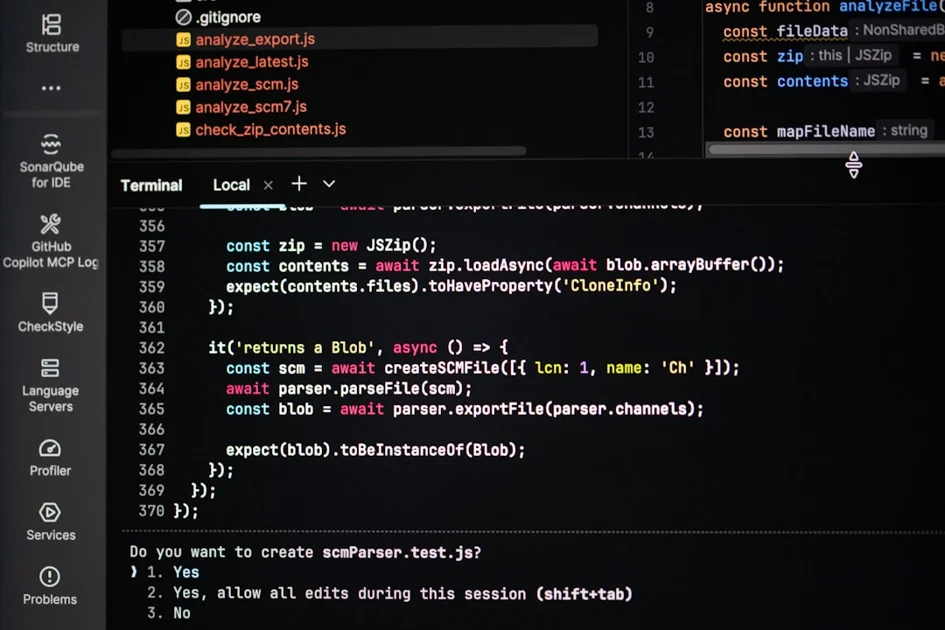

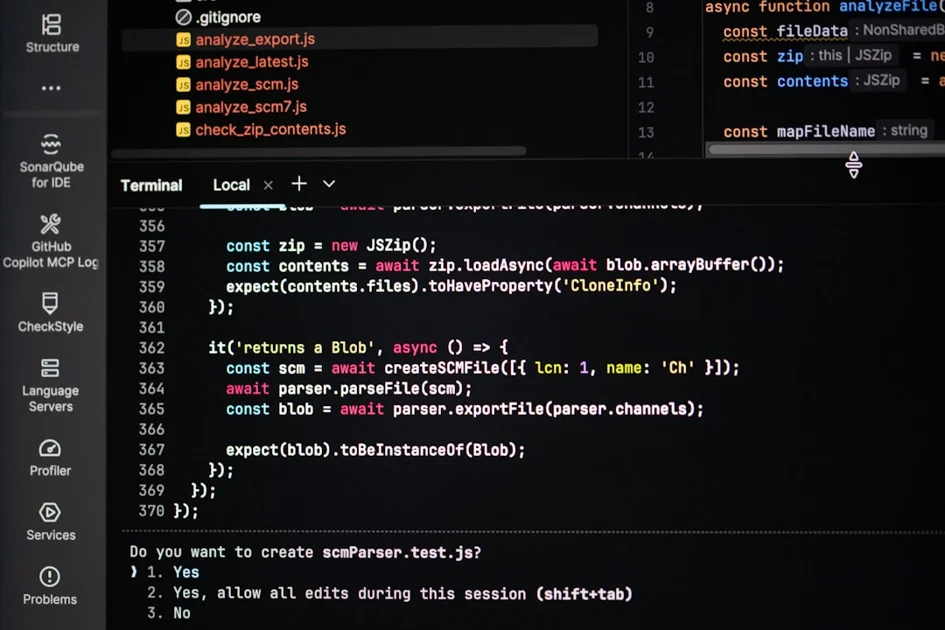

- ~/.claude/projects/ 경로의 로컬 JSON 로그를 파싱하여 세션 및 작업 단위로 데이터를 구조화하는 CodeBurn CLI 도입

- --per-task 옵션을 통한 Atomic Commit 메시지 기반의 작업별 Token 소모량 매핑 로직 적용

- Token 소모 패턴을 'Context 읽기', '코드 생성', '에러 수정', '최종 검증'의 4단계 라이프사이클로 분리하여 분석

- Correction Token과 Generation Token의 비율을 계산하여 초기 Specification의 정확도를 정량적으로 측정

- CLAUDE.md 파일 및 @file 명시적 지정으로 불필요한 Context 추론을 방지하는 최적화 전략 수립

실천 포인트

1. CLAUDE.md 파일을 최신 상태로 유지하여 AI의 불필요한 파일 탐색 및 Context 추론 방지

2. Prompt 작성 시 인터페이스 정의와 의존성 순서를 명시적으로 제공하여 Correction Loop 최소화

3. Atomic Commit 습관을 통해 작업 단위별 Token 효율성을 측정하고 Prompting 전략 피드백 루프 구축