피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

LLM 비용 83% 절감, 3단계 계층형 라우팅 아키텍처 설계

I Was Paying $0.006 Per URL for SEO Audits Until I Realized Most Needed $0

AI 요약

Context

모든 SEO 감사 URL에 대해 고비용 LLM을 호출하는 구조. 단순 글자 수 확인과 같은 결정론적 작업에 과도한 비용 지출 발생. 불필요한 LLM 의존도로 인한 비용 효율성 저하 및 레이턴시 증가 문제 직면.

Technical Solution

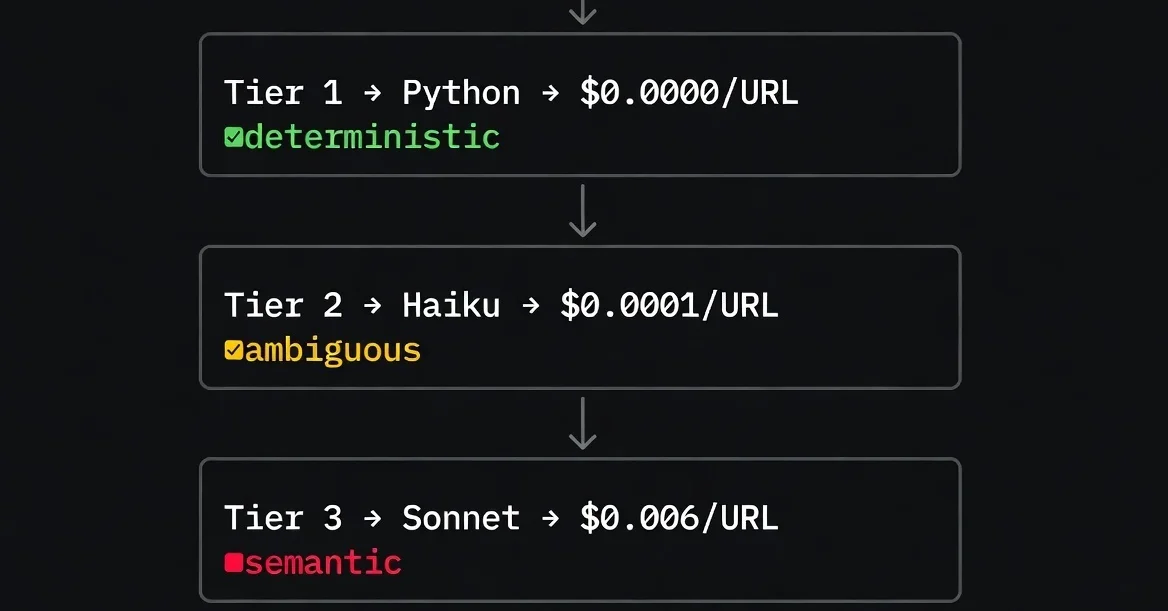

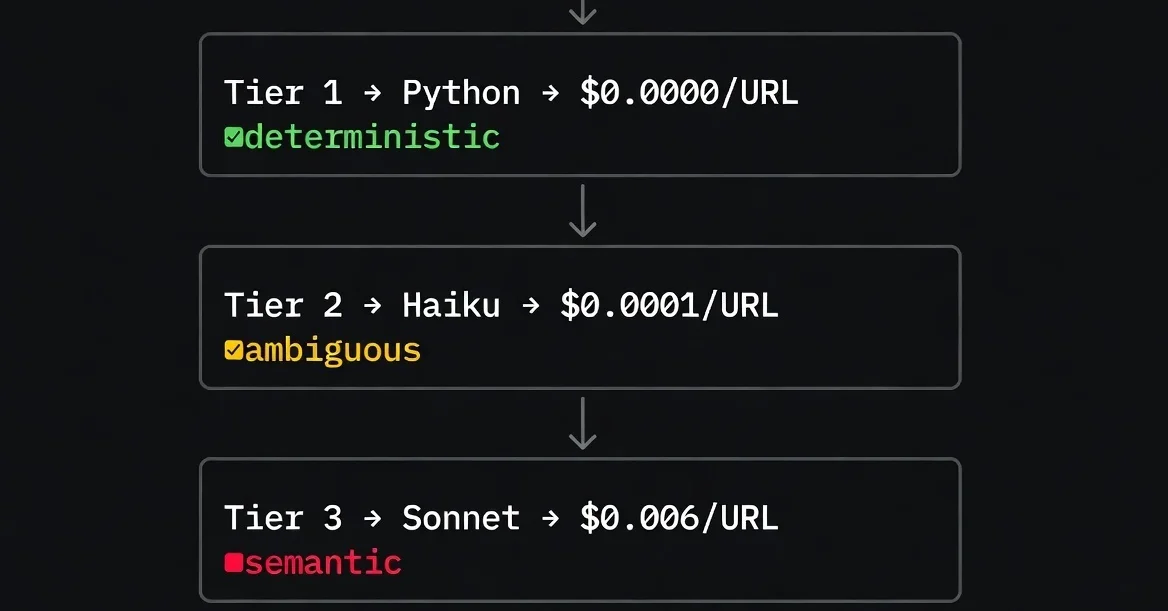

- 정규표현식 기반의 Deterministic Python을 최우선 배치하여 기본 규칙 검증 및 비용 제로화 실현

- 단순 규칙은 통과했으나 모호함이 감지된 케이스만 경량 모델인 Haiku로 라우팅하는 중간 필터링 단계 구축

- 하이쿠 모델이 판단한 시맨틱 분석 필요 항목만 최상위 모델인 Sonnet으로 전달하는 3단계 Cost Curve 아키텍처 설계

- core 패키지와 premium 패키지를 완전히 분리하여 MIT 라이선스 기반의 공개 코드와 독점 기능을 격리한 의존성 구조 채택

- state.json을 통한 감사 이력 관리로 단순 스냅샷을 넘어선 시계열 모니터링 체계 구현

- 사용자 작성 샘플 텍스트를 프롬프트에 포함하여 LLM 특유의 말투를 제거한 맞춤형 리라이트 에이전트 기능 추가

Impact

- URL당 비용 $0.006에서 평균 $0.001 수준으로 감소

- 50개 URL 처리 기준 총 비용 $0.30에서 $0.05로 약 83% 절감

- 전체 요청 중 84%의 케이스를 Tier 1(무료) 단계에서 해결

Key Takeaway

모든 문제에 고성능 모델을 투입하는 대신 작업의 복잡도에 따라 처리 단계를 나누는 계층적 라우팅 설계가 비용과 효율의 최적점을 결정함.

실천 포인트

LLM 파이프라인 설계 시 단순 규칙 기반 필터를 최전방에 배치하여 토큰 소모를 최소화할 것