피드로 돌아가기

Hugging Face BlogAI/ML

Hugging Face BlogAI/ML

원문 읽기

Hugging Face가 Optimum 라이브러리를 통해 Transformer 모델을 Graphcore IPU에서 최적화 실행 가능하도록 통합해 레이턴시 민감 애플리케이션 지원

Getting Started with Hugging Face Transformers for IPUs with Optimum

AI 요약

Context

Transformer 모델은 다양한 머신러닝 작업에서 효율적이지만, 예측 속도가 느려 대화형 애플리케이션이나 검색 같은 레이턴시 민감 사용 사례에 부실용적이다. 모델 성능 최적화는 많은 기업과 조직이 접근하기 어려운 수준의 시간, 노력, 기술을 필요로 한다.

Technical Solution

- Optimum 라이브러리 도입: Hugging Face Transformers와 Graphcore IPU 간 인터페이스 제공으로 하드웨어 추상화

- BERT 모델 IPU 최적화 구현: Graphcore 엔지니어가 Hugging Face Transformers를 기반으로 BERT를 IPU 시스템용으로 구현 및 최적화

- PopTorch 환경 구성: Poplar SDK 및 PopART를 통해 PyTorch 모델을 IPU에서 실행 가능하도록 최소 코드 변경으로 설정

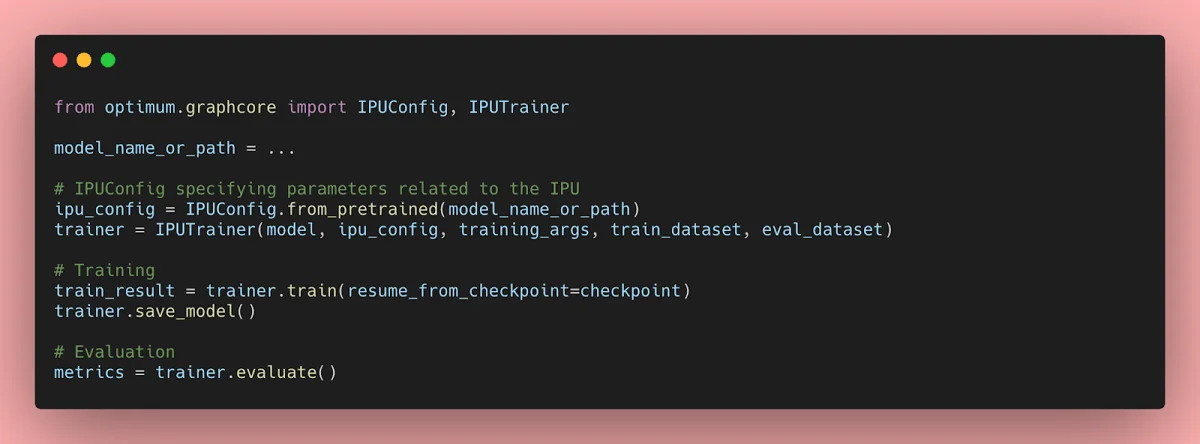

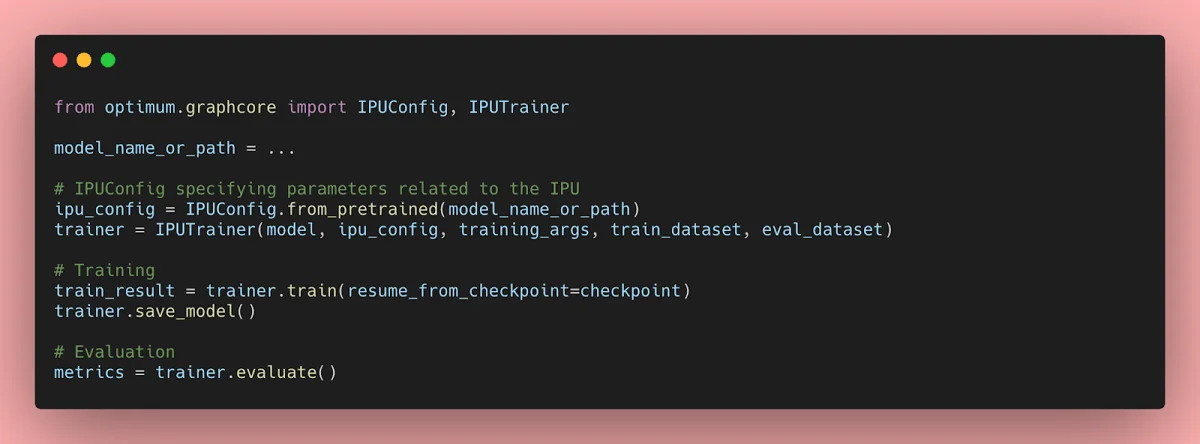

- IPUTrainer 클래스 활용: Optimum에서 제공하는 IPUTrainer를 사용해 상태 최신 모델을 IPU에서 학습 및 검증

- SQuAD 1.1 데이터셋 기반 미세조정: Hugging Face Datasets 라이브러리를 통해 표준화된 데이터셋 로드 및 Fast Tokenizer를 통한 전처리

Impact

- BERT 모델 학습(SQuAD 1.1, 3에포크): 학습 속도 720.877 샘플/초, 스텝 속도 2.809 스텝/초, 학습 손실 0.9465

- 검증 결과: Exact Match 80.6623%, F1 점수 88.2757%

Key Takeaway

Hugging Face와 하드웨어 제공자의 파트너십 모델을 통해 상태 최신 오픈소스 모델을 특화 하드웨어에서 즉시 사용 가능하도록 제공하면, 엔지니어가 기울어진 학습곡선 없이 최적화 이점을 활용할 수 있다.

실천 포인트

Transformer 모델을 특화 AI 하드웨어(예: Graphcore IPU)에 배포하려는 팀은 Optimum 같은 추상화 라이브러리를 통해 모델 코드 변경을 최소화하면서 PopTorch와 IPUTrainer 같은 플랫폼 특화 도구를 활용해 학습 시간 단축 및 예측 지연 감소를 달성할 수 있다.