피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

월 $0.02 비용으로 구현하는 3계층 기반 AI Persistent Memory 아키텍처

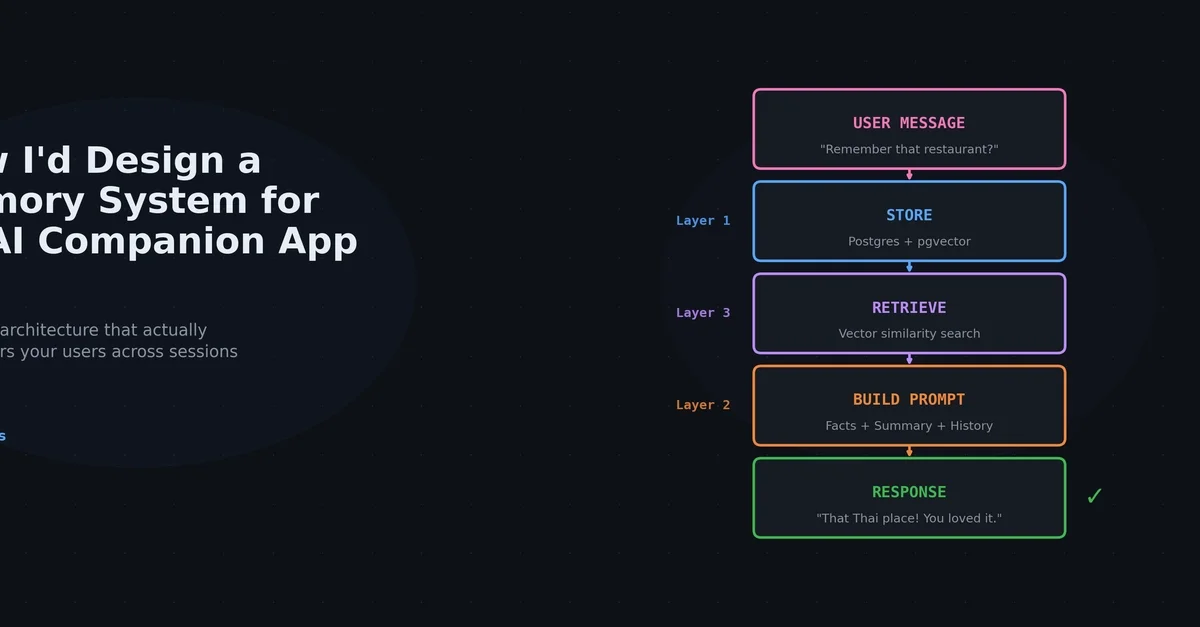

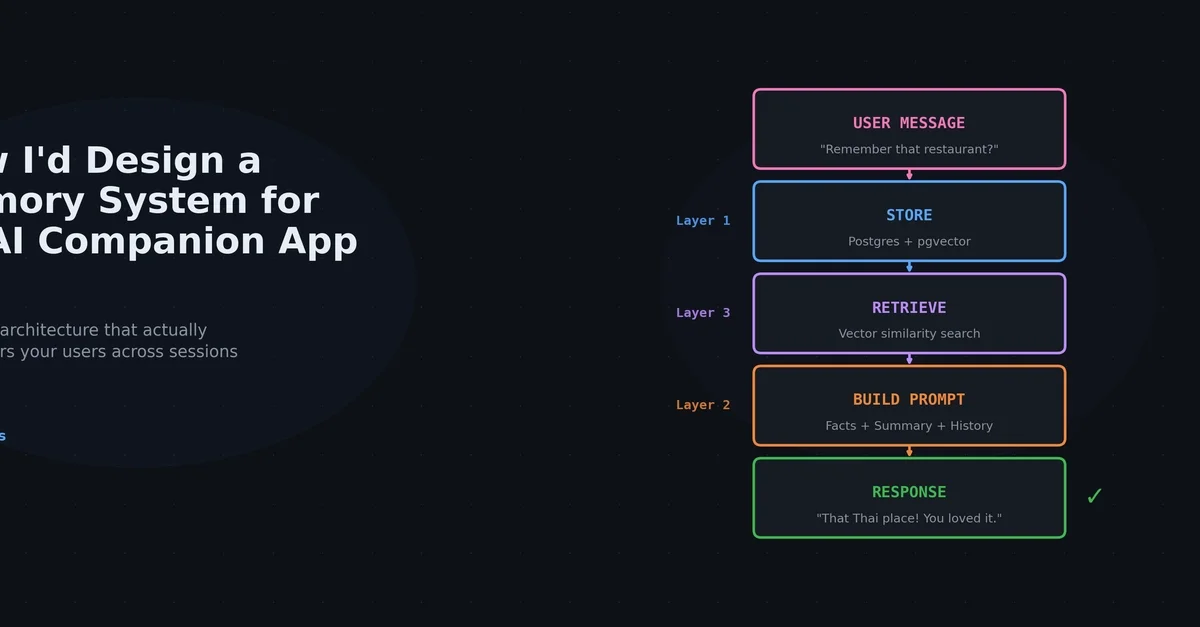

How I'd Design a Memory System for an AI Companion App

AI 요약

Context

LLM의 Stateless 특성으로 인한 Context Window 의존적 설계의 한계 분석. 세션 간 정보 유실과 단순 버퍼 확장 방식의 비효율성으로 인한 사용자 경험 저하 발생.

Technical Solution

- Postgres 기반의 Conversation Log 레이어를 통한 모든 메시지 원본 보존 및 Write-time 메타데이터 태깅 설계

- Fact Store와 Relationship Summary를 포함한 Memory Index 레이어로 사용자 정체성의 압축적 지식 저장

- Vector Embedding 및 Similarity Search를 통한 Retrieval Engine 레이어로 특정 시점의 세부 기억 동적 복원

- Haiku-tier 모델을 활용한 비동기 Fact Extraction 및 Sonnet-tier 모델 기반의 배치형 관계 요약 업데이트

- 압축된 요약 정보와 동적 검색 결과의 결합을 통한 정체성 유지와 세부 기억 소환의 상호 보완 구조 구축

- 중요 정보의 망각 방지를 위한 Salience 기반의 Memory Floor 메커니즘 적용

Impact

- 10K DAU 기준 월 운영 비용 약 $200 수준의 고효율 인프라 구축

- 사용자당 월 $0.02의 비용으로 영구적인 세션 간 기억 유지 가능

Key Takeaway

단순한 Context Window 확장보다 '압축된 지식'과 '동적 검색'의 계층적 분리가 시스템의 일관성과 디테일을 동시에 확보하는 핵심 설계 원칙임.

실천 포인트

- 단순 RAG 도입 전, 전역적 정체성을 위한 Summary 레이어와 국소적 기억을 위한 Retrieval 레이어의 분리 여부 검토 - 데이터 쓰기 시점에 주제, 감정, 개인적 사실 등의 메타데이터를 태깅하여 검색 비용 최적화 - LLM의 망각 현상을 방지하기 위해 시간 경과와 무관하게 유지되는 '중요 정보 하한선(Memory Floor)' 설정 - 1,000개 이상의 메시지와 다수 세션을 활용한 사실 복원 벤치마크 테스트 수행