피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

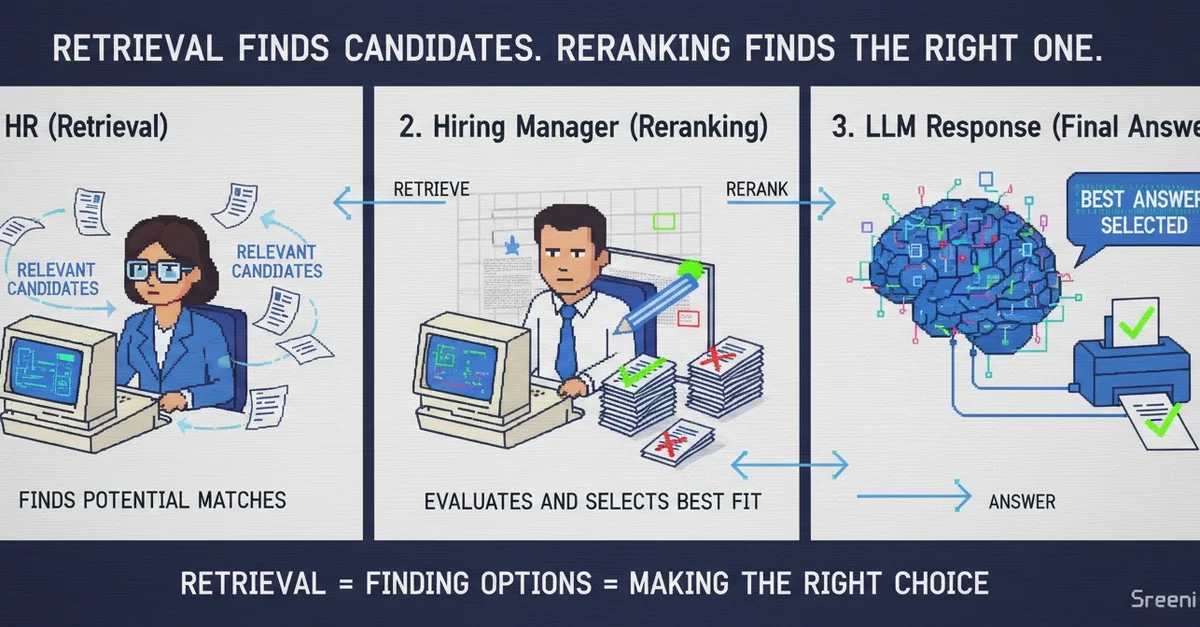

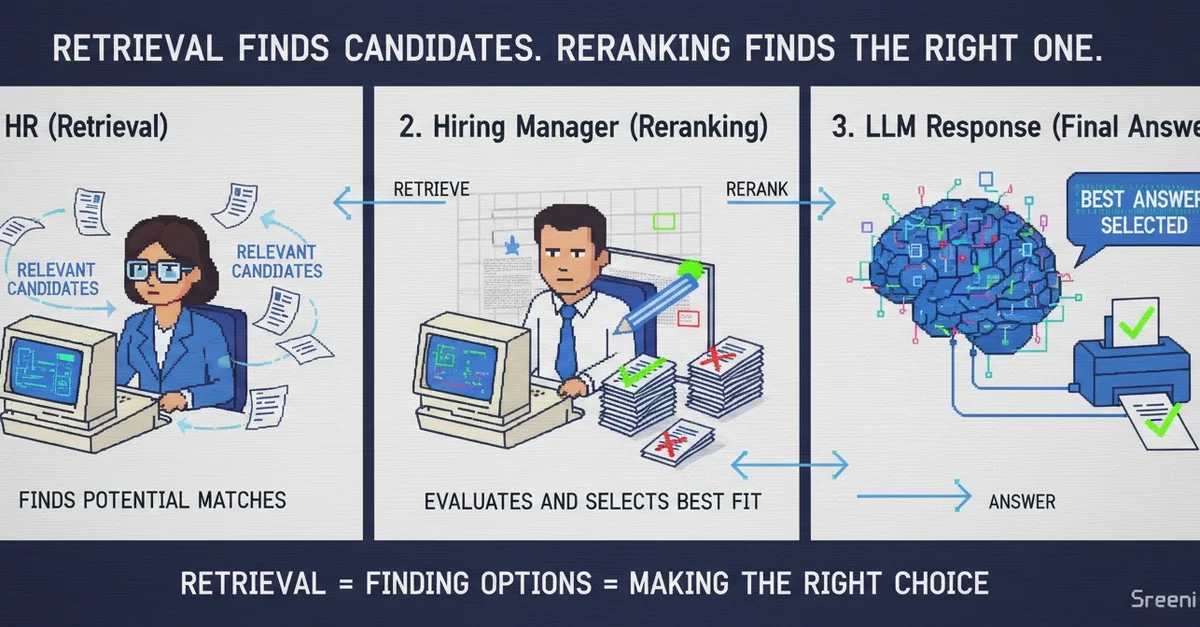

RAG에서 retrieval은 후보 목록을 생성하고 reranking은 그중 정답을 선택하는 과정이다

Retrieval Finds Candidates. Reranking Finds the Right One.

AI 요약

Context

LLM은 학습 데이터 외부의 문서를 알지 못한다. RAG는 외부 문서를 검색해 컨텍스트로 추가하는 구조로 이 한계를 극복한다. Retrieval 단계에서 벡터 유사도로 관련 문서를 빠르게 검색하지만, 토픽 유사성과 실제 질문과의 의미적 관련성은 다른 개념이다.

Technical Solution

- RAG 시스템(FAISS, Pinecone, Weaviate) → 벡터 임베딩 기반 상위 K개 문서 검색

- 코히어Rerank API → 질문과 문서를 쌍으로 입력하는 cross-encoder 방식으로 의미적 연관성 평가

- 각 문서에 relevance_score(0~1) 부여

- 상위 N개 문서만 LLM 생성 단계에 전달

Impact

코히어Rerank 예시에서 refund 정책 질문 시 relevance_score 0.9821, 0.7134, 0.4821로 정확히 일치하는 문서가 최상위로 배치됨

Key Takeaway

Retrieval은 선택지를 늘리고, Reranking은 정답을 결정한다. 두 단계 모두 RAG 시스템에서 필수적이다.

실천 포인트

RAG 검색 품질 향상이 필요한 시스템에서 retrieval 단계 후 semantic relevance를 평가하는 reranking 모듈을 추가하면 approximate similarity에서 precise relevance로 전환되어 LLM 입력 품질이 개선된다