피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

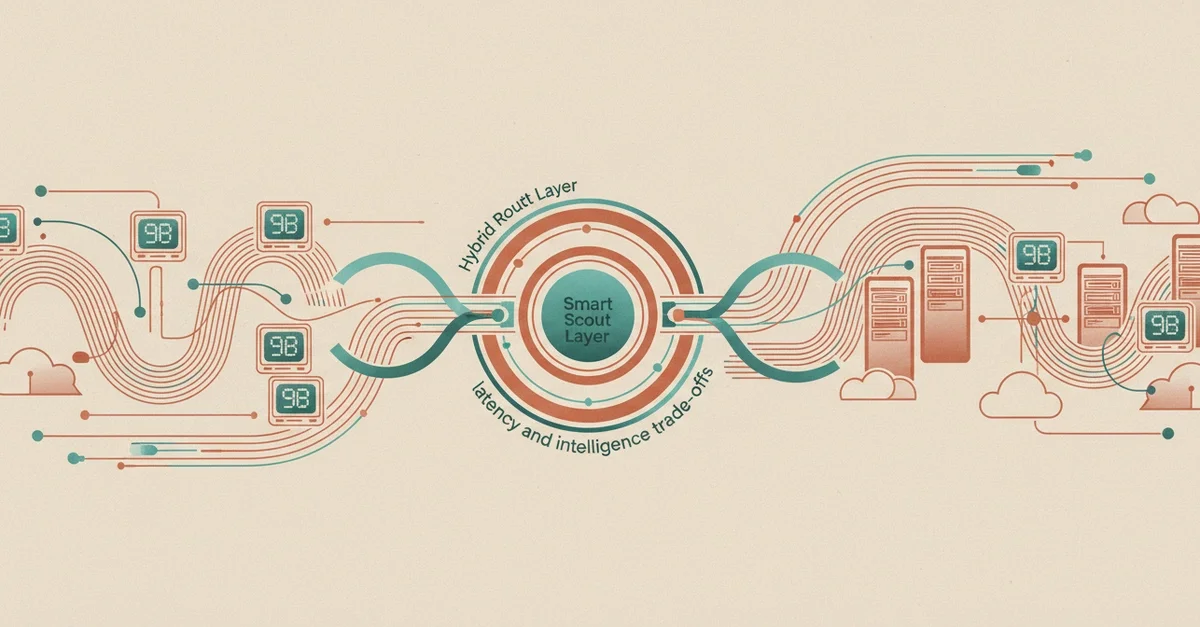

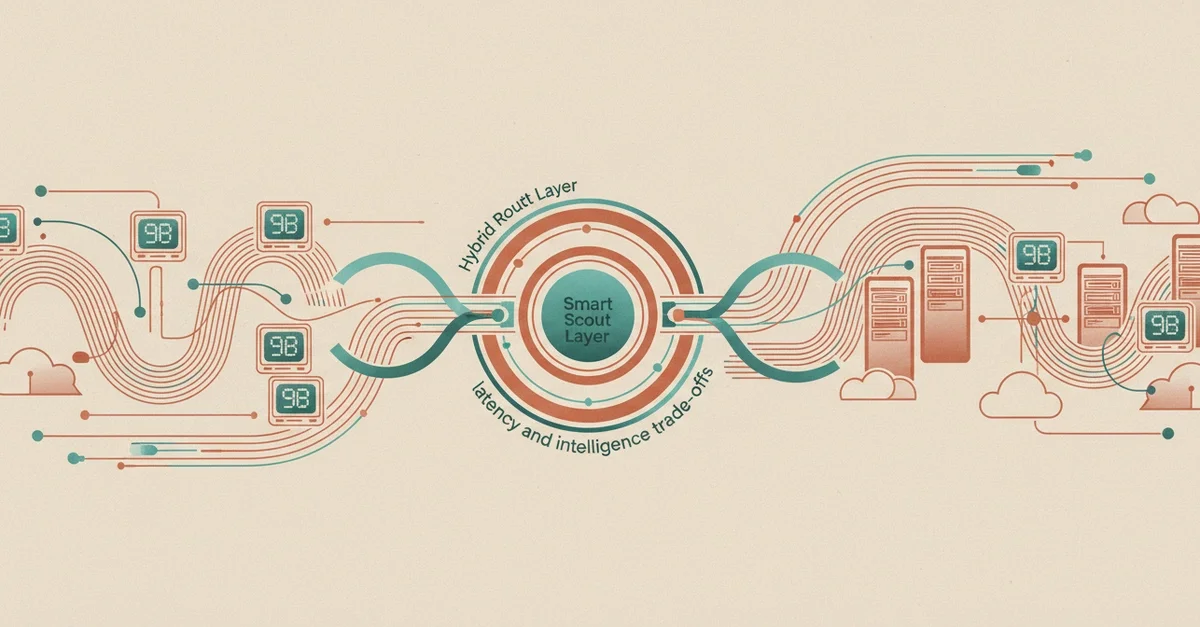

일일 비용 $0.17, 로컬-클라우드 하이브리드 LLM 라우터 설계

The Hitchhiker's Guide to Running Agentic Systems Locally

AI 요약

Context

지능적 모델은 높은 Latency와 비용을 유발하는 구조. 로컬 소형 모델은 추론 능력의 한계로 인해 복잡한 논리 구조에서 환각 현상 발생. 단일 모델 의존도는 API 비용 증가와 제공사 정책 변화에 따른 운영 리스크를 초래하는 설계.

Technical Solution

- 키워드 매칭의 한계를 극복하기 위해 제약 조건 밀도, 컨텍스트 압박, Scout Classifier의 3가지 신호 벡터 기반 라우팅 전략 채택

- 50ms 미만으로 작동하는 1B 규모의 경량 모델을 Scout Classifier로 활용하여 프롬프트 난이도를 Trivial, Standard, Complex로 분류

- 8k 토큰 이상의 입력 시 Needle-in-a-haystack 성능 저하를 방지하기 위해 클라우드 모델로 자동 전환하는 경로 설계

- 도구 호출(Tool-calling)의 JSON 문법 오류를 방지하고자 일반 작업은 q4_K_M, 구조화된 출력 작업은 q8_0 양자화 모델을 분리 운영

- asyncio를 통한 병렬 평가와 Pydantic 기반의 타입 검증을 적용하여 로컬 모델 실패 시 클라우드로 즉시 전환되는 Fallback 메커니즘 구축

Impact

- 헤비 유저 기준 일일 운영 비용 약 $0.17 달성

- Scout Classifier의 처리 지연 시간 50ms 미만 유지

Key Takeaway

인프라의 안정성과 비용 효율성을 위해 클라우드 추론을 필수 의존성이 아닌 성능 업그레이드 옵션으로 취급하는 하이브리드 추론 계층 설계의 중요성.

실천 포인트

구조화된 데이터 출력이 필요한 Task에는 q4 이하 양자화 모델 대신 q8_0 이상의 정밀도를 가진 모델을 할당하여 런타임 에러를 방지할 것