피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

개발자가 AI 에이전트의 통제 불안을 해결하기 위해 Actra 거버넌스 시스템을 구축한 과정

I stopped trusting AI agents to “do the right thing” - so I built a governance system

AI 요약

Context

AI 에이전트는 데모에서 인상적으로 동작하지만 실제로는 행위를 통제할 수 없는 한계가 존재한다. AI 실패는 충돌이 아니라 조용하고 그럴듯하며 대부분 되돌릴 수 없는 특성을 가진다. 신뢰가 아닌 검증을 통해 행위를 제어해야 한다.

Technical Solution

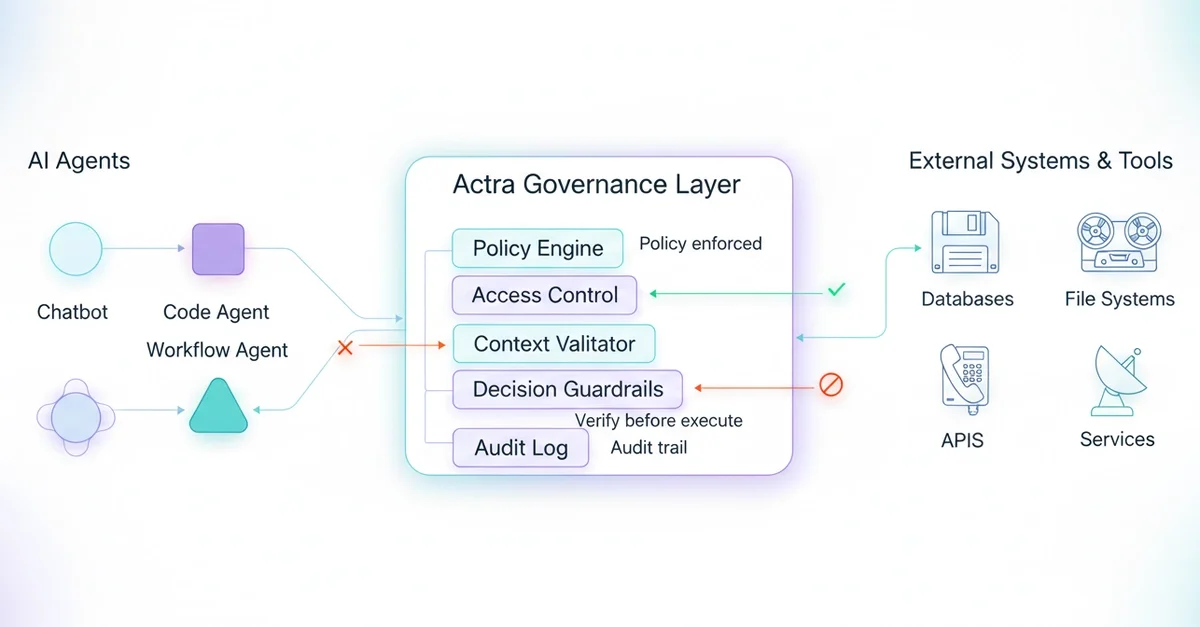

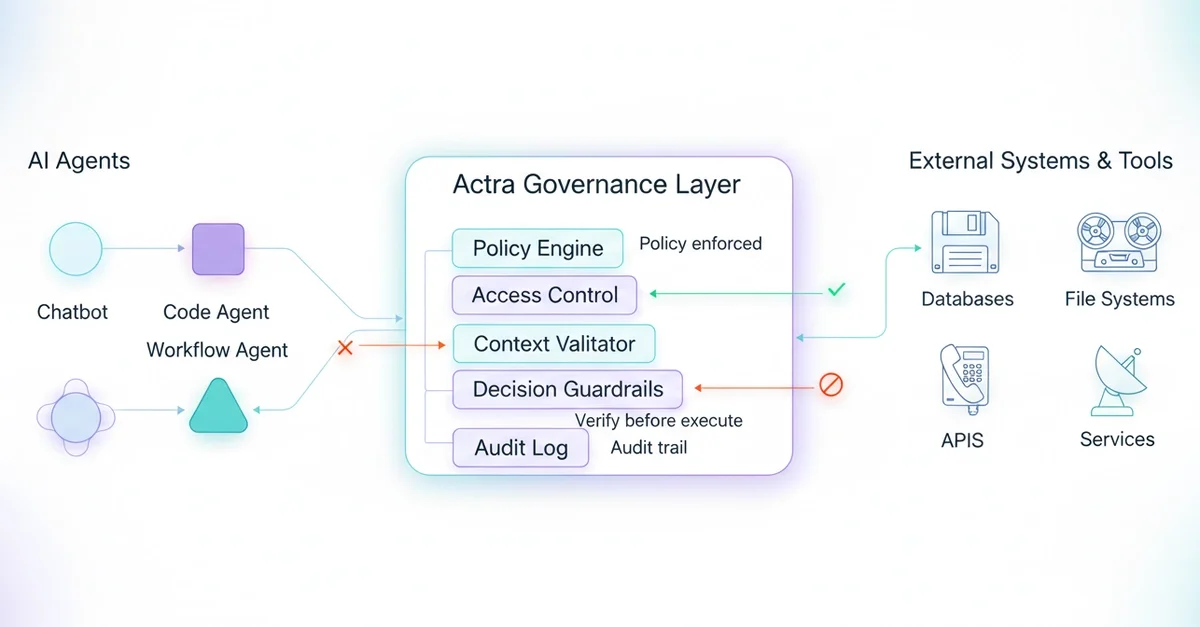

- 에이전트와 외부 세계 사이에 Actra 제어 계층을 삽입한다

- 도구 호출, API 요청, 부작용이 있는 결정에 대해 실행 전 평가를 수행한다

- 도구 오용, 프롬프트 인젝션, 무제한 결정이라는 세 가지 예측 가능한 실패 모드를 차단한다

- Rust로 작성된 핵심 엔진과 WASM 지원을 통해 플랫폼 독립적 정책 평가를 가능하게 한다

- Python과 JavaScript SDK를 제공하여 다양한 런타임과 에이전트 프레임워크에서 동작한다

Impact

정량적 성능 변화 없음

Key Takeaway

AI 시스템은 지능 문제가 아니라 통제 문제이며, 정렬 대신 정책을 강제하는 것이 현실적인 접근법이다.

실천 포인트

도구 호출, 민감 데이터 접근, 실시간 액션 실행이 가능한 AI 에이전트 환경에서 실행 전 정책 검증 계층을 적용 시 예측 불가능한 행위可能导致하는的危害를 억제할 수 있다