피드로 돌아가기

Dev.toDevOps

Dev.toDevOps

원문 읽기

Metric-to-Log 상관관계 분석으로 Root Cause 분석 시간 2분 이내 단축

I Added Log Aggregation to My EKS Observability Stack, Metrics + Logs in One Dashboard

AI 요약

Context

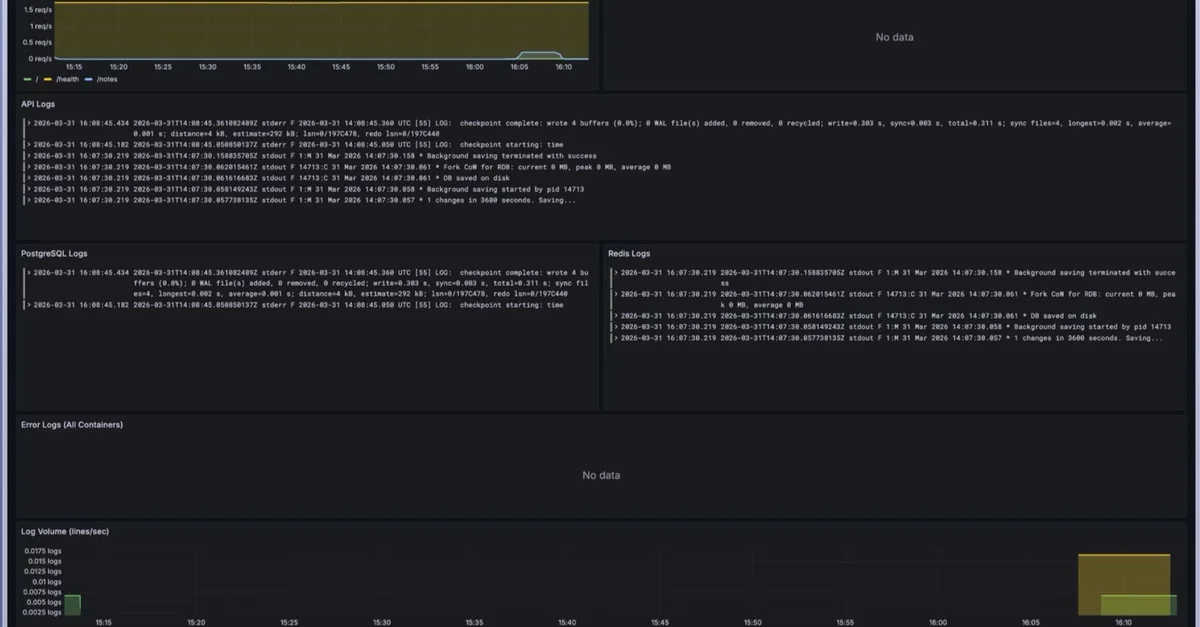

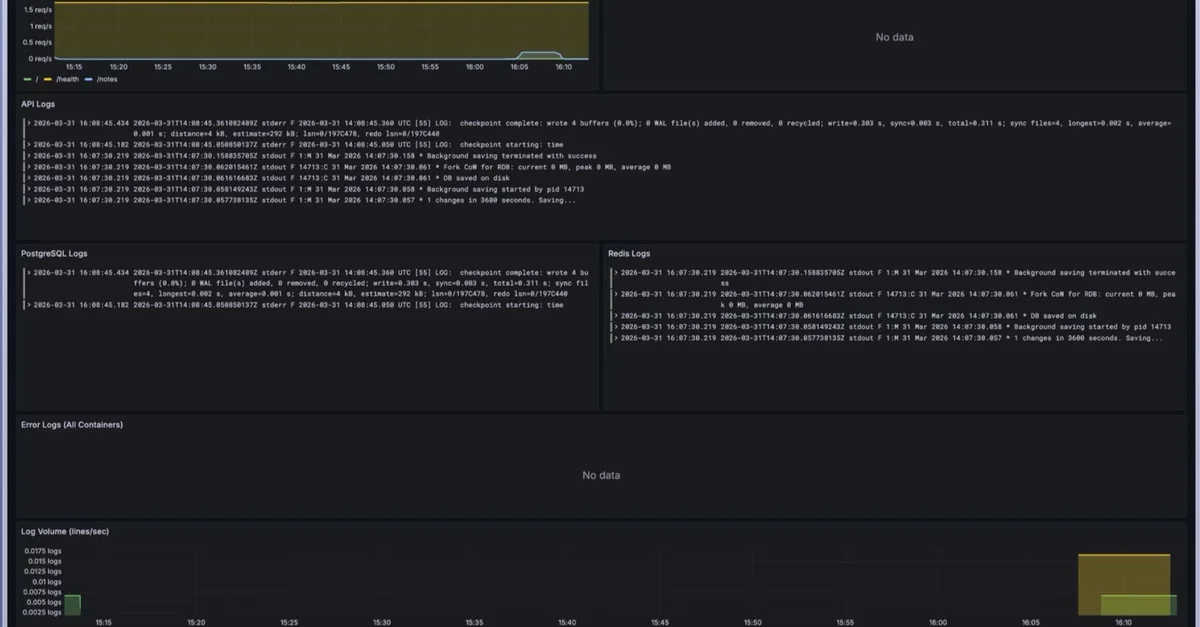

Prometheus 기반의 Metrics 모니터링만으로는 장애 발생 원인 파악에 한계 존재. 로그 확인을 위해 kubectl logs와 Grafana 대시보드를 수동으로 교차 확인하는 비효율적인 워크플로우 발생.

Technical Solution

- Loki와 Promtail을 도입하여 EKS 노드 내 /var/log/pods 경로의 컨테이너 로그를 실시간 수집하는 구조 설계

- ArgoCD를 통한 Loki 스택, Grafana Datasource, Dashboard ConfigMap의 GitOps 기반 배포 자동화

- LogQL의 스트림 선택자와 파이프라인 필터링을 사용하여 특정 네임스페이스 및 에러 키워드 중심의 로그 추출 방식 적용

- Grafana 대시보드 내 Metrics 패널과 Logs 패널을 시간축으로 동기화하여 지표 급증 시점의 로그를 즉시 확인하는 상관관계 분석 환경 구축

- LogQL의 rate() 함수를 활용해 로그 발생 빈도를 시계열 지표로 변환하여 에러 스톰(Error Storm) 탐지 체계 마련

Impact

- Root Cause 분석 시간 2분 이내로 단축

- t3.medium 노드당 최대 Pod 수용량 약 17개 제한 확인

Key Takeaway

단순한 장애 탐지를 넘어 진단까지 이어지는 Observability를 완성하려면 Metric, Log, Trace의 시간축 동기화와 통합 뷰(Unified View) 확보가 필수적임.

실천 포인트

t3.medium 등 소형 노드 사용 시 모니터링 스택 추가에 따른 Pod 수용량 초과 가능성을 고려하여 Node Group 스케일링 전략을 수립할 것