피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

NemoClaw와 Ollama로 구축하는 Zero-Trust 로컬 AI 에이전트 설계

Architecting Secure Local-First AI Agents with NemoClaw, Podman, and Ollama

AI 요약

Context

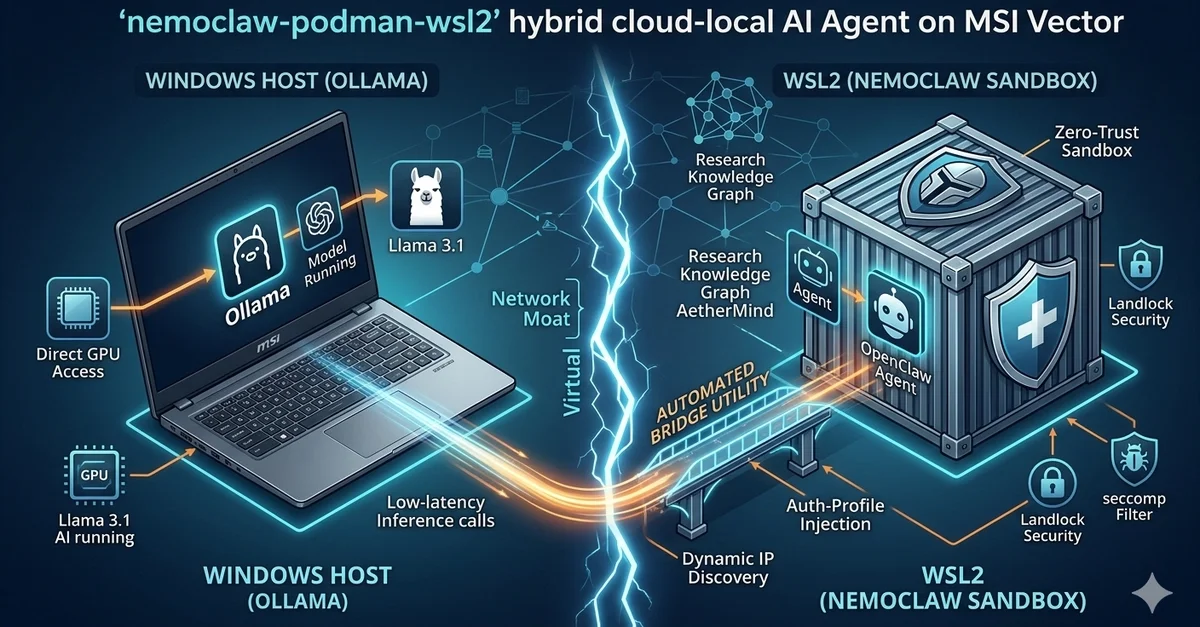

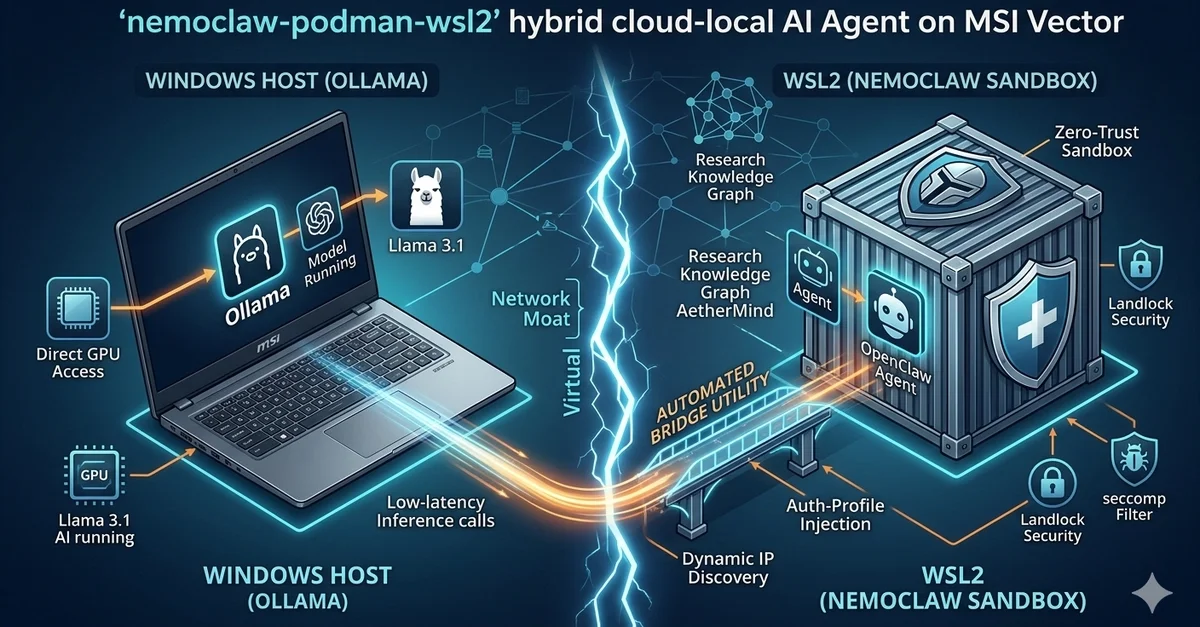

데이터 주권 확보를 위해 클라우드 LLM 대신 로컬 환경 구축 필요. Windows 호스트의 Ollama와 WSL2 기반 NemoClaw 간의 네트워크 격리 발생. 기본 설정 시 로컬 모델 연결 실패 및 클라우드 API 강제 전환 문제 존재.

Technical Solution

- NVIDIA NemoClaw의 Landlock 및 seccomp 기능을 활용한 커널 수준 샌드박스 보안 설계

- WSL nameserver를 통해 Windows 호스트 IP를 실시간으로 해결하는 Dynamic IP Discovery 메커니즘 구현

- auth-profiles.json 스택 최상단에 로컬 Ollama 제공자를 주입하여 클라우드 우선 순위 로직 제거

- Podman 컨테이너 런타임을 통한 가벼운 로컬 컨테이너 관리 환경 최적화

- Windows 방화벽의 11434 포트 인바운드 허용 및 Ollama 모든 인터페이스 리스닝 설정으로 통신 경로 확보

Key Takeaway

에이전트의 '실행 권한(Hands)'은 보안 샌드박스에 격리하고 '추론 엔진(Brain)'은 고성능 호스트 자원을 활용하는 분리 설계 전략.

실천 포인트

WSL2와 Windows 호스트 간 AI 모델 통신 시 Dynamic IP Discovery 유틸리티를 통해 IP 변동 대응 체계를 구축할 것