피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

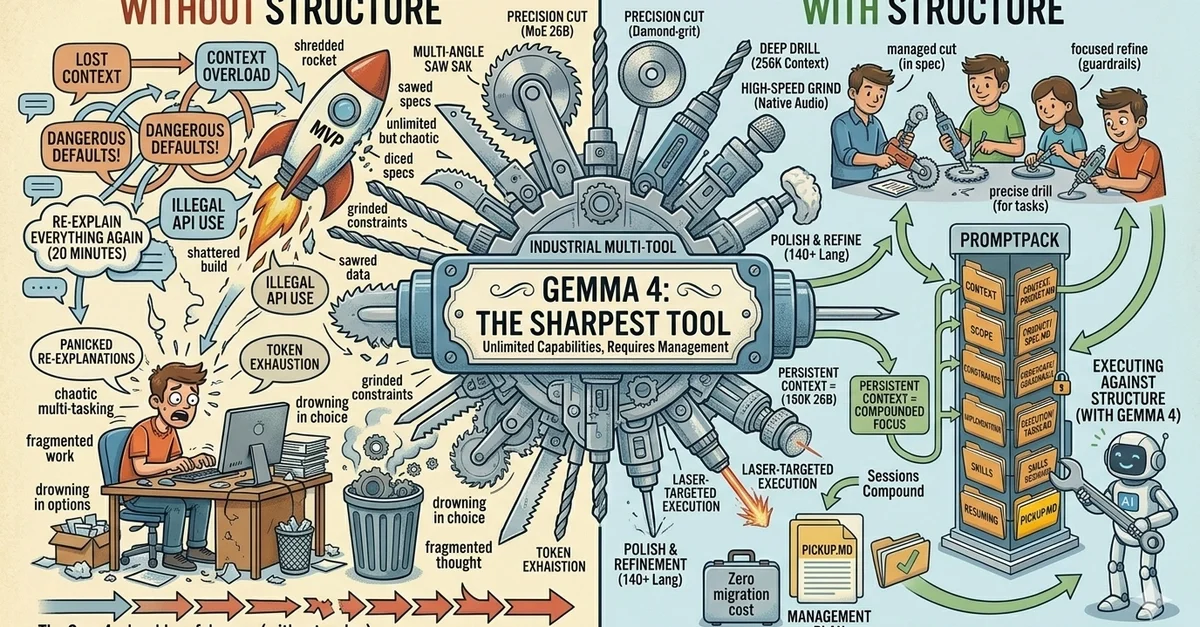

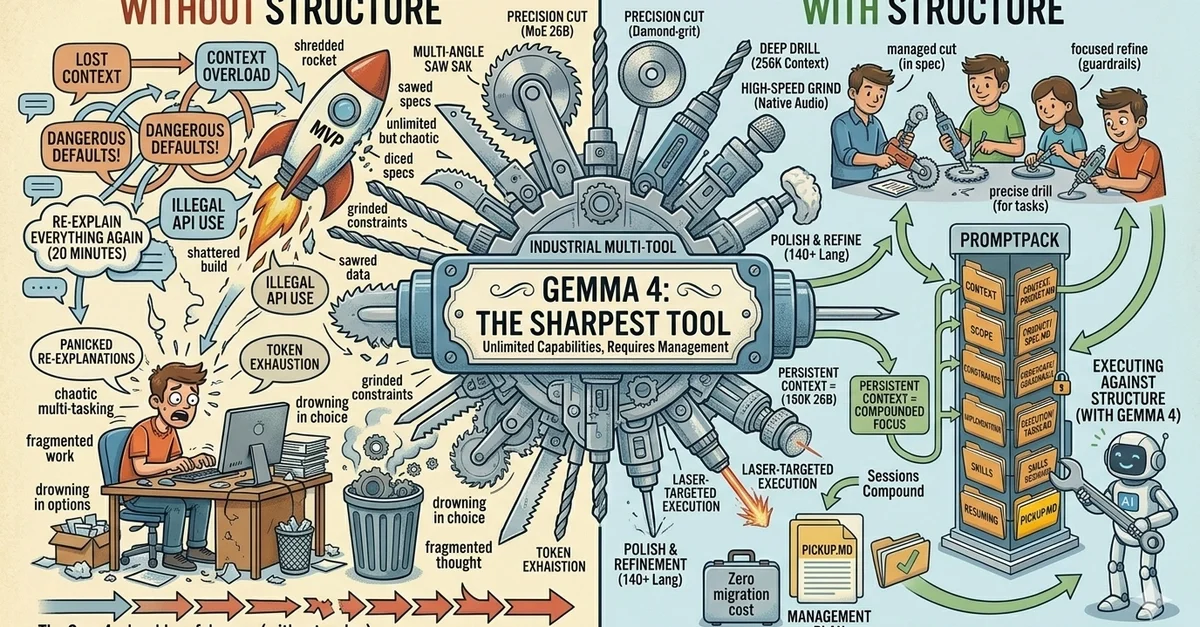

Gemma 4 로컬 LLM의 성능 극대화, 핵심은 구조적 컨텍스트 관리

Gemma 4 Just Dropped. It's the Sharpest Tool in the Shed. Do You Have a Plan?

AI 요약

Context

로컬 LLM 환경은 클라우드 플랫폼의 가드레일과 세션 관리 기능이 부재한 상태. 무제한 쿼리와 제로 비용의 이점이 있으나 체계적인 관리 없이는 문맥 손실과 작업 중복 발생. 개발자가 직접 세션 연속성과 컨텍스트 범위를 제어해야 하는 구조적 책임 수반.

Technical Solution

- 채팅 기반의 휘발성 소통에서 Markdown 중심의 정적 기록 체계로 전환하는 전략

- 세션 시작과 종료 시

PICKUP.md파일을 통해 결정 사항과 다음 단계의 이력을 동기화하는 연속성 확보 방식 - 256K Context Window 전체를 사용하지 않고 작업 단계별로 Orientation, Core, Deep 레이어로 나누어 로드하는 Progressive Disclosure 설계

- 코드 구현 전 제약 사항과 경계 조건 및 필수 준수 사항을 명시하는 Guardrail 정의 프로세스 도입

- 하드웨어 성능에 의존하지 않고 README, Spec, Constraint 파일로 구성된 프로젝트 구조를 통한 모델 제어 최적화

Impact

- 26B MoE 모델 기준 3.8B Active Parameters만으로 AIME 2026 88.3% 달성

- 31B Dense 모델 기준 전 세계 오픈 모델 순위 3위 기록

- 256K Context Window 및 140개 이상의 언어 지원

Key Takeaway

강력한 성능의 로컬 모델일수록 하드웨어 사양보다 체계적인 프로젝트 구조와 컨텍스트 관리 설계가 최종 결과물의 품질을 결정함.

실천 포인트

로컬 LLM 도입 시 단순 채팅 대신 Markdown 기반의 상태 관리 파일(PICKUP.md)을 운용하여 컨텍스트 단절을 방지할 것