피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

Bayesian Optimization을 통한 고비용 모델 튜닝 효율 극대화

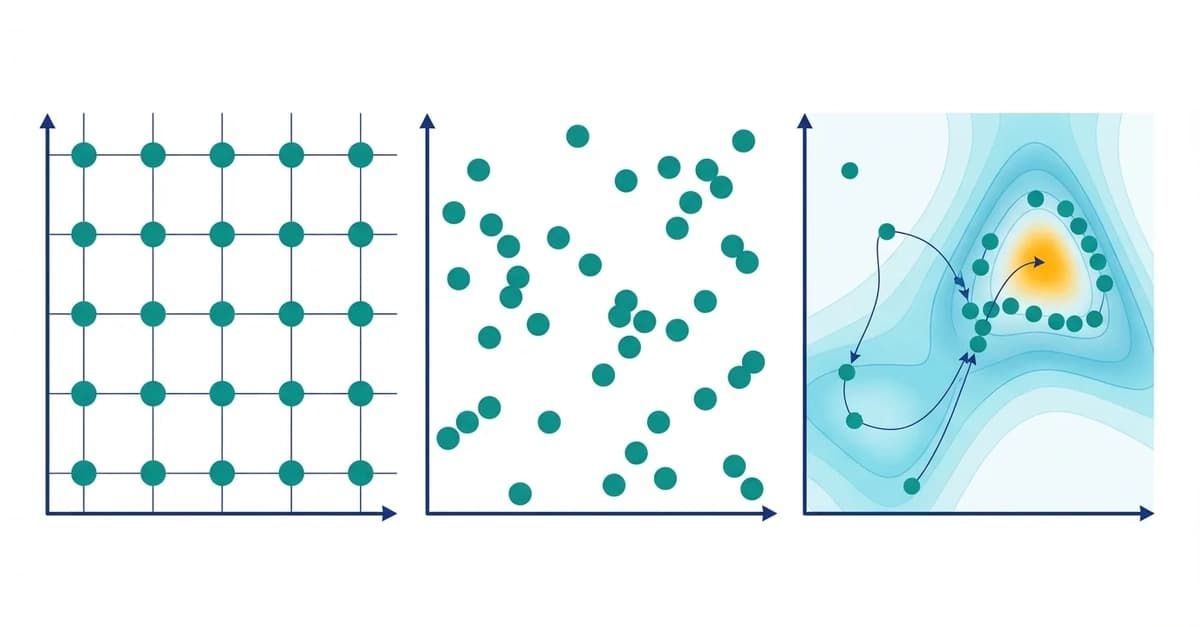

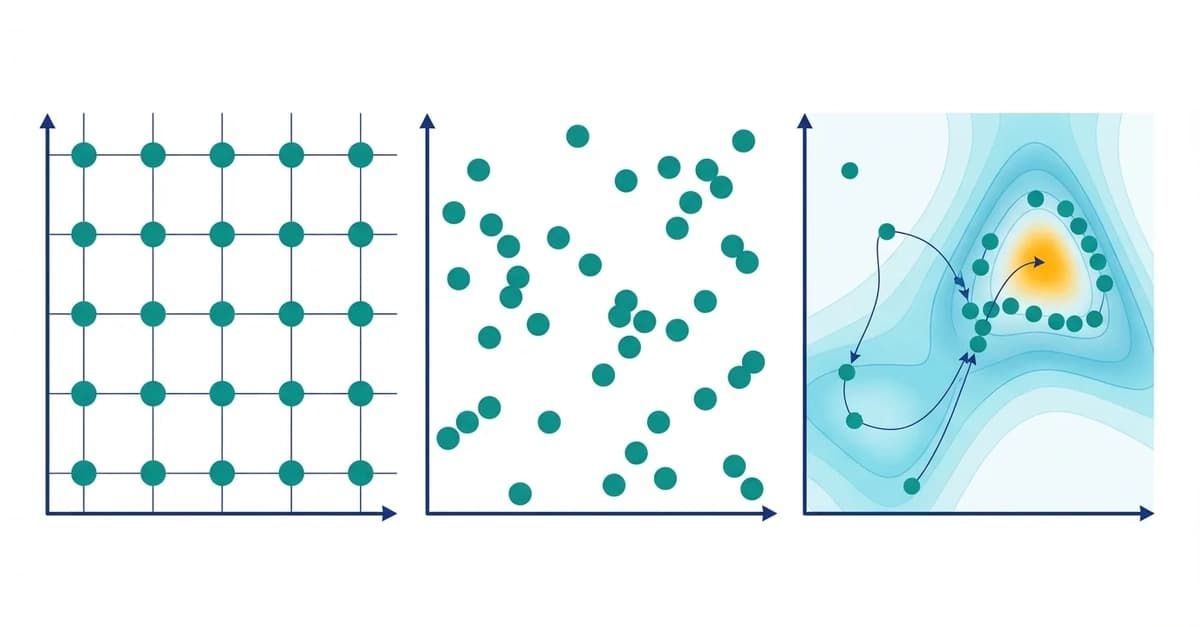

Hyperparameter Optimization: Grid vs Random vs Bayesian

AI 요약

Context

Hyperparameter 최적화 과정의 Combinatorial Explosion으로 인한 연산 비용 급증 문제 발생. Neural Network와 같이 튜닝 파라미터가 10~20개로 늘어날 경우 Exhaustive Search가 물리적으로 불가능한 한계 존재.

Technical Solution

- Grid Search의 모든 조합 탐색 방식에서 벗어나 predefined grid의 비효율성 제거

- Random Search를 통한 Hyperparameter 공간의 Uniform Sampling으로 유효 파라미터 탐색 효율 개선

- Bayesian Optimization의 Gaussian Process 도입을 통한 목적 함수(Objective Function)의 확률적 모델링 구현

- 이전 평가 결과를 바탕으로 다음 탐색 지점을 결정하는 Intelligent Search 전략 채택

- K-fold Cross-validation을 통한 Validation Set Overfitting 방지 및 성능 추정치 신뢰도 확보

- 평가 비용(Training Time)과 탐색 공간의 차원 수에 따른 최적 알고리즘 선택 구조 설계

실천 포인트

1. 평가 비용이 저렴하고 파라미터가 적다면 Random Search를 우선 검토

2. 모델 학습에 수 시간이 소요되는 고비용 환경이라면 Bayesian Optimization 도입

3. 탐색 공간의 차원이 20차원 이하인지 확인 후 Bayesian 전략 적용

4. 신뢰도 높은 성능 측정을 위해 기본 5-fold Cross-validation 적용

태그