피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

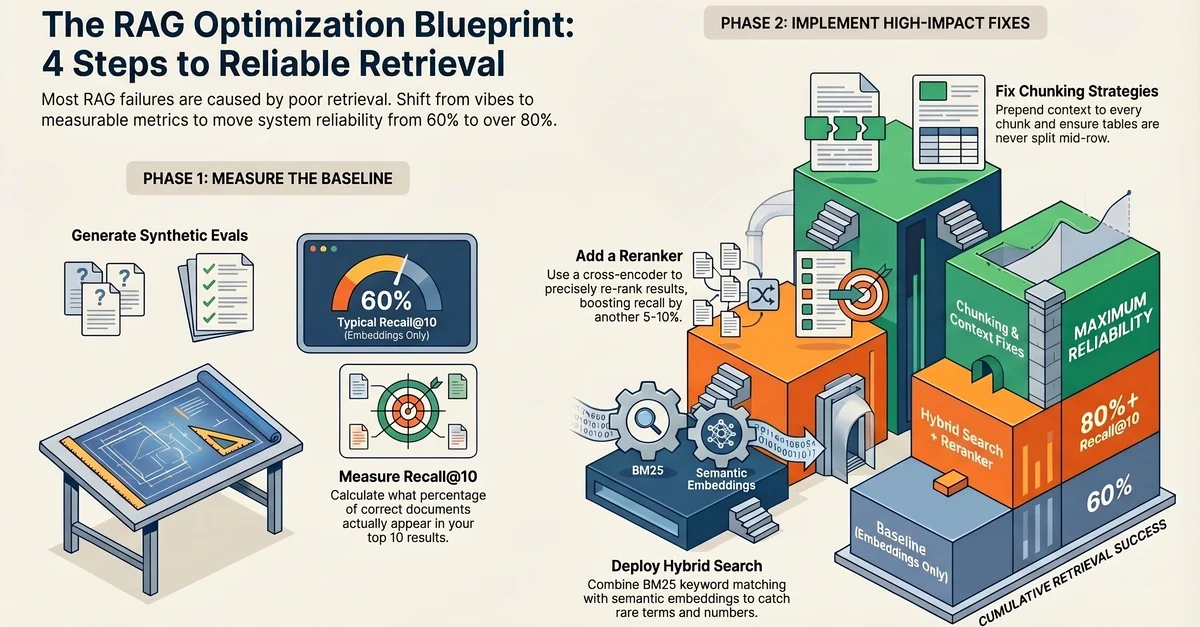

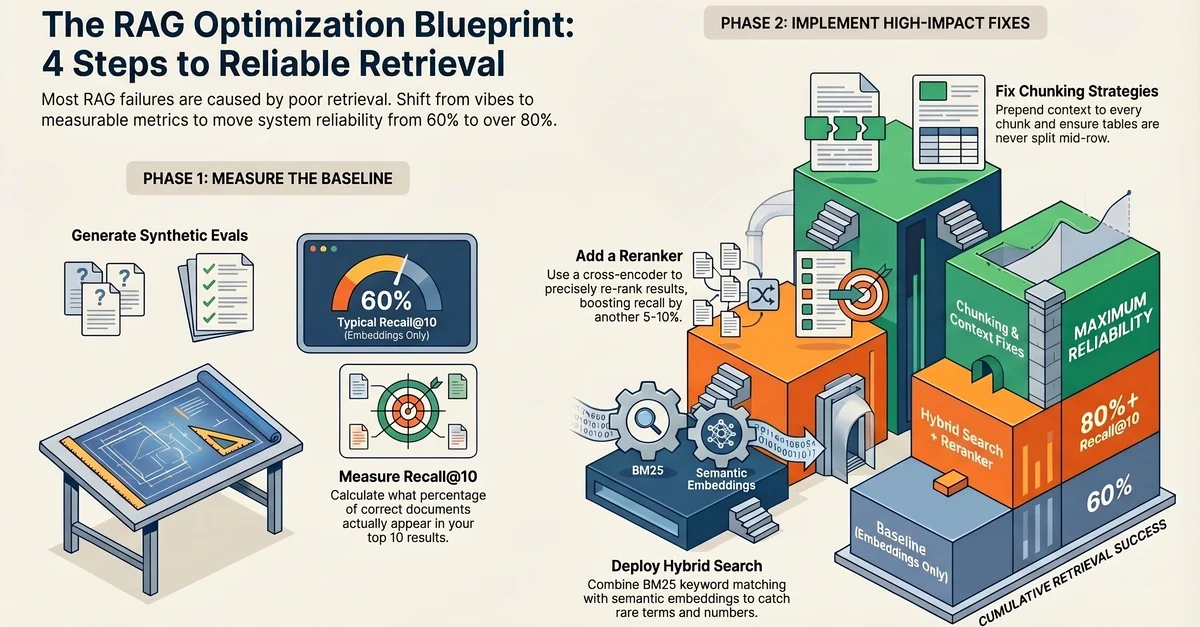

Recall@10 측정과 Hybrid Search/Reranker 도입을 통한 RAG 정확도 60%에서 80%로 개선

My First RAG System Had No Evals. 40% of Answers Were Wrong.

AI 요약

Context

정량적 지표 없이 사용자 경험에 의존한 RAG 시스템 배포로 인한 낮은 응답 정확도 문제 발생. 분석 결과 LLM의 생성 능력이 아닌, 필요한 문서가 컨텍스트 윈도우에 포함되지 않는 Retrieval 단계의 병목 현상 식별.

Technical Solution

- Recall@k 지표 도입을 통한 Retrieval 품질의 독립적 측정 및 정량적 Baseline 구축

- Semantic Search의 한계인 숫자 및 고유 식별자 검색 보완을 위해 BM25를 결합한 Hybrid Search 설계

- Reciprocal Rank Fusion(RRF) 알고리즘을 적용하여 서로 다른 검색 랭킹 점수를 단일 스코어로 통합

- Bi-encoder의 속도와 Cross-encoder의 정밀도를 결합한 2-단계 검색 구조 및 Reranker 도입

- Chunk 단독으로 의미 파악이 어려운 'it' 문제 해결을 위해 문서 제목과 섹션 헤더를 포함하는 Context Prepending 전략 적용

- LLM-as-judge 기반의 합성 데이터 생성으로 실제 트래픽 없이도 검증 가능한 Evaluation Dataset 구축

실천 포인트

1. Recall@10 측정으로 Retrieval 성능 baseline 확보

2. 키워드/ID 검색 누락 방지를 위한 Hybrid Search 적용

3. 정밀도 향상을 위한 Cross-encoder 기반 Reranking 단계 추가

4. Chunking 시 상위 컨텍스트(제목, 섹션명)를 접두어로 추가하여 의미론적 독립성 확보

5. LLM을 활용한 합성 데이터셋 기반의 자동화된 Eval 파이프라인 구축