피드로 돌아가기

Dev.toAI/ML

Dev.toAI/ML

원문 읽기

AI 모델은 학습 시점의 스냅샷만 보유하여 현재 시스템 미연결로 정확한 답변 제공 불가함

Why AI Gets Things Wrong (And Can't Use Your Data)

AI 요약

Context

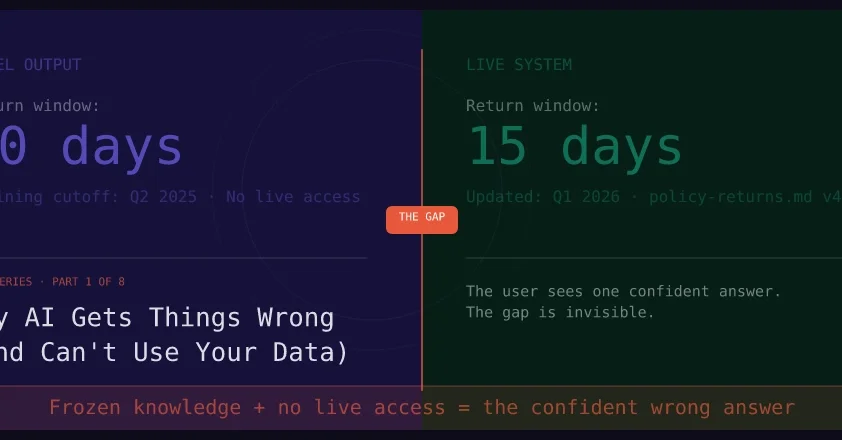

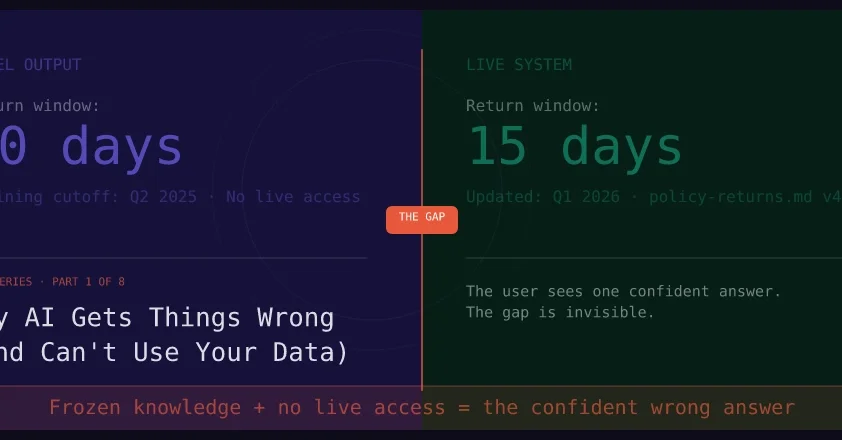

AI 어시스턴트가 TechNova의 WH-1000 헤드폰 반품 정책을 30일로 안내함. 그러나 실제 정책은지난 분기에 15일로 변경됨. 모델은 환불 기한이 종료된 후에도 확신에 찬 잘못된 답변을 생성함. 이 문제는 모델의 지식이 학습 시점의 스냅샷에 고정되어 있고 현재 시스템에 접근할 수 없는 데서 발생함.

Technical Solution

- Frozen Knowledge 문제: 모델은 특정 시점까지의 데이터로만 학습되어 그 이후 변경사항을 반영 불가함

- No Live System Access 문제: 모델은 쿼리 시점에 정책 DB나 CMS에 연결할 수 없어 학습된 고정 내부 상태에서만 답변 생성함

- Fine-tuning의 한계: 동작 방식이나 톤은 변경하지만 지식의 시점 자체는 변하지 않아 scheduled snapshot에 불과함

- RAG(Retrieval-Augmented Generation): 모델이 먼저 외부 소스에서 현재 정책을 검색한 후 검색된 내용에 기반하여 답변을 생성하는 패턴으로 전환함

Key Takeaway

정확한 답변의 근본적 문제는 모델 지능의 부족이 아니라 현재 시스템과의 연결 부재임. Fine-tuning은 동작 변경이지 지식 업데이트가 아니며, 지식의 시점 문제를 해결하려면 실시간 검색 메커니즘인 RAG 패턴이 필수임.

실천 포인트

AI 어시스턴트 구축 시 학습 데이터와 현재 시스템 간격차가 답변 품질을 좌우함을 인식하고, Fine-tuning 도입 전 RAG 패턴 적용을 우선 검토해야 함. 특히 정책이나 가격처럼 빈번히 변경되는 도메인에서는 retrieval 단계의 정확도가 전체 답변 품질을 결정함.